蒸馏不是攻击:当一个工程术语被立法妖魔化

一、Anthropic 一发警告,国会就动了

4 月 28 号,Anthropic 发了份安全警告,点名三家中国实验室对它的模型做"distillation attacks"。

第二天,众议院相关委员会通过了 H.R. 8283。三天后,白宫颁了 NSTM-4 行政令。再过几天,国会的调查盯上了 Cursor。

节奏快得反常。一个工程术语,正在被立法变成攻击行为。

Nathan Lambert 在 Interconnects 那篇《The distillation panic》里说得很直白——这是一次精心安排的恐慌。Anthropic 的报告写法、媒体的转述口径、立法的语言措辞,几乎是同一套词汇表在不同部门轮番出现。这不是巧合。

二、真正的问题不是蒸馏

蒸馏(knowledge distillation)是 Hinton 2015 年提的训练方法。用大模型生成数据训练小模型,让小模型继承大模型的判别能力。

这是行业日常。Nvidia 的 Nemotron、Ai2 的 Olmo、Ollama 的 OCR 模型——全都靠蒸馏。任何一家做产品的公司,要把 70B 大模型的能力压到 7B 跑边缘设备,都绕不开它。

那 Anthropic 报告里说的"distillation attacks"具体指什么?

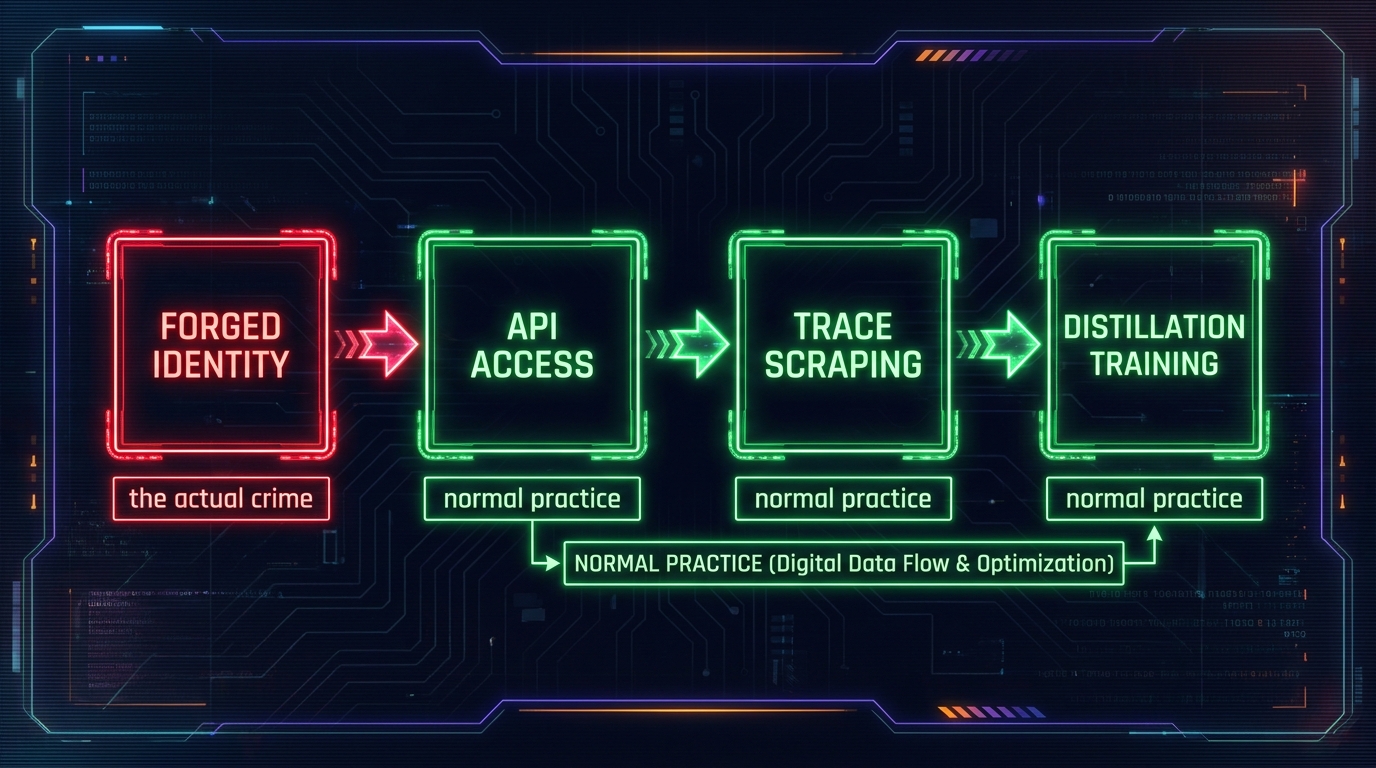

读完原文你会发现,问题不是蒸馏。问题是越狱(jailbreaking)和 ToS 滥用。某些实验室伪造身份注册 API、绕过速率限制、抓推理过程的中间步骤。这是合同违约和欺诈——不是技术本身的问题。

把"越狱拿数据"和"蒸馏训练"捆在一起说,等于把"偷自来水管"叫成"喝水攻击"。喝水没问题,偷管子才是问题。但你要立法禁的是"蒸馏"这个动作,不是"伪造身份"这个动作。

这是一次概念替换。技术术语被嫁接到了它本不该背的锅上。

三、原告自己也在蒸馏

这事最尴尬的是 xAI。

法庭文件里,Musk 的律师团队承认 xAI 训练时用了 OpenAI 的输出。Musk 自己在 X 上发言:

"Most AI companies distill each other."

OpenAI 怎么训出 GPT-3.5 Turbo 的小版本?蒸馏。Anthropic 的 Claude Haiku 怎么来的?蒸馏 Sonnet。Meta 的 Llama 3 系列里那些 8B、70B、405B 参数模型——同一个数据管道,互相蒸馏。

整个行业每天都在做这件事。

当被告是中国实验室时,定义就变了——这就是双标。Anthropic 的报告里没有提自家也是 distillation 的高强度使用者,没有提整个行业都在用同一种技术。它只把镜头对准三家中国机构,把"我们用的是合法蒸馏,他们用的是攻击"这条线划得很清楚。但这条线其实不存在。

四、这次语言污染,眼熟得很

不是第一次了。

5 年前,"开源"被窄化成"权重发布"。Llama 不公开训练数据、不公开训练代码,但因为放权重,被说成"开源"。OSI(开源软件促进会)专门发声明区分"open source"和"open weights"——但媒体懒得管,就这么混着用了。

输的是谁?真正的开源社区,和那些靠"开源"定义吃饭的小公司。一旦"开源"被偷走、贴到任何放权重的产品上,真开源就失去了语言上的辨识度。

今天是同样剧本。"蒸馏"在被窄化成"未授权获取数据训练模型"。一旦立法把这个定义固化,所有合法用蒸馏训练小模型的公司——尤其是没有自己大模型的初创公司——都会变成"嫌疑人"。

每次语言被污染,输的都不是大公司。大公司有法务、有游说预算、有自己的大模型不需要去蒸馏别人。受伤的永远是中间那批:学术研究者、独立开发者、做垂直 SaaS 的小团队。

五、Lambert 的反驳:封锁帮龙国

Nathan Lambert 在那篇文章里有段话特别尖锐:

"If all the XX companies are addicted to distillation, they'll never actually learn. If we cut off, we'll gain a short-term lead but may give them a more competitive long-term trajectory."

意思是:某些实验室如果一直靠蒸馏美国闭源模型,永远建不起自己的训练能力。这对美国是好事——它们走的是依附路线。

但你一断供,强迫它们自研,反而把它们推上独立路线。短期赢了,长期输得更难看。

DeepSeek-R1 就是答案。它从训练数据到 RL 流水线全部自研,不靠 OpenAI 输出。它能在 2025 年初炸出来,恰恰是因为更早的封锁。

封锁的标准结局——对手要么死,要么变得更强。它从来不会一直在依附状态停留。

六、H.R. 8283 真过了,对中国 AI 创业者意味着什么

H.R. 8283 如果通过,第一波被波及的不是 DeepSeek、Qwen 这些已经上岸的实验室。是出海的中国 AI 应用公司。

具体三个场景:

第一,OpenAI / Anthropic 的 API 使用门槛会抬高。 注册身份审查变严,IP 池管理变严,可能引入"使用模式异常"的封号机制。任何"看起来在批量调用"的中国账号,都会被标红。即使你完全合规,也可能被殃及。

第二,国内基于 OpenAI 输出做 SFT 的小模型公司,海外渠道会被切断。 出海部署、找海外客户、上 AWS Bedrock 那类合规市场——全部受影响。如果你的产品架构里有"调 GPT 生成数据训我们的小模型"这条流水线,未来 6 个月内必须找替代。

第三,蒸馏类产品的话术包装会变贵。 以前你的官网可以写"基于 GPT-4 蒸馏的轻量推理模型",现在这句话本身就是合规风险。要么用"自研合成数据流水线"重新包装,要么干脆切到开源底座(Llama、DeepSeek、Qwen)。

应对策略很清楚:别把闭源 API 当训练管道。 要么早点切到开源底座做 SFT,要么自建合成数据流水线,要么把"蒸馏"二字从公司对外材料里彻底删掉。

更深一层——这件事提醒所有创业者,闭源 API 永远是临时基础设施。它的可用性不取决于价格,取决于政治。今天可以禁中国 IP,明天可以禁某个行业,后天可以禁某种用途。把核心能力建在别人的 API 上,等于把房子盖在别人的地基上。

七、保护 API 安全 ≠ 禁掉一个技术

Lambert 的建议很中性:保护 API 安全,公开技术细节。 该抓的是越狱和身份伪造,不是 distillation 这个词。

但立法的诱惑就是把复杂问题简化成一个动词。"禁止 distillation"比"禁止伪造身份注册 API 批量获取推理数据进行未授权模型训练"好喊得多。前者一个词,后者一长句。

国会要的是好喊的口号,闭源公司要的是好用的工具。两边一拍即合,输的就是开源开发者。

技术词汇不是中立的。一个词被立法定义,整个行业的话语权就被改写了。今天是 distillation,明天可能是 fine-tuning,后天可能是 synthetic data。每一个被妖魔化的词,背后都是被关上的一扇门。

金句留底

把蒸馏说成攻击,等于把蒸馏当毒品。但全行业都在用它——包括原告自己。

杀掉 distillation 这个词,是闭源公司的 PR 胜利,是开源开发者的失败。

闭源 API 永远是临时基础设施。它的可用性不取决于价格,取决于政治。

短期赢了,长期输得更难看。这是封锁的标准结局。