莫洛克就住在你的 OKR 里

所有人都恨这个系统,但没有人能独自退出。——这不是某个反乌托邦小说的设定,这是你每天上班的地方。

每家公司都在提效,但效率去了哪里?

2026 年,中国科技圈最高频的词汇不是"创新",是"降本增效"。

阿里在用 AI 替代客服。字节在用 AI 生成内容。保险公司在用 AI 做核保。每家公司的 CEO 都在季度会上说同一句话:"我们要用 AI 把效率再提 30%。"

假设他们都做到了。然后呢?

你效率提了 30%,你的竞争对手也提了 30%。市场没有变大,客户没有增加,你们俩又回到了同一条起跑线上——只不过现在各自少了一半的员工。

效率的红利去了哪里?它蒸发了。

这不是一个新问题。2014 年,一个叫 Scott Alexander 的人在一篇名为《Meditations on Moloch》的长文里,用一个古老的隐喻给这个现象起了个名字:莫洛克。

莫洛克不是谁,莫洛克是什么

莫洛克是古代迦南人的神,以吞噬儿童为祭品著称。Allen Ginsberg 在他的诗作《嚎叫》里重新召唤了这个意象,用来指代那些吞噬人类价值的系统性力量。

Scott Alexander 把这个隐喻往前推了一步。他说,莫洛克不是某个邪恶的人或组织。莫洛克是一种结构性的力量——当所有参与者都在理性地追求自己的利益时,集体却走向了所有人都不想要的结果。

他列举了十四个例子:囚徒困境、军备竞赛、环境污染、教育内卷、科学界的发表偏见、国会的低效……每一个例子的结构都一样:

- 所有人都知道有更好的选项

- 但没有人能单方面切换到那个选项,因为切换的人会被淘汰

- 于是所有人被锁死在一个所有人都讨厌的均衡里

他给这个机制起了个技术名称:多极陷阱(multipolar trap)。

听起来很学术?其实不。你每天都活在里面。

降本增效:莫洛克的中国名字

让我把 Alexander 的 fish farming 例子翻译成中国版。

假设有十家保险科技公司在香港市场竞争。其中一家率先引入了 AI 核保系统,把核保时间从 3 天压缩到 3 分钟,人力成本砍掉 70%。

短期内,这家公司赢了。利润暴涨,客户体验飙升,投资人开香槟。

三个月后,其他九家公司全部跟进。因为不跟进就意味着成本比对手高 70%,客户等待时间比对手长 1000 倍。在竞争中,这等于死亡。

六个月后,十家公司都有了 AI 核保。市场回到了同一起跑线。但有一样东西回不来了:那些被裁掉的核保员。他们的经验、判断力和对边缘案例的直觉,已经随着他们的离开而消散。

这就是莫洛克的运作方式:每个参与者的理性选择,汇总成集体的非理性结果。效率提升了,但没有任何人变得更好。

我不是在讲一个假设场景。我是一家科技公司的 CDO。我亲手推动了这件事。

我就是那个按下按钮的人。

我造了七个 Agent 产品,我是莫洛克的帮手

过去三年,我从零到一打造了七个以上的 AI Agent 产品:给做客户经营的、给企业做智能获客的、做 Agent 评测排行榜的、做多 Agent 协作编排的……

每一个产品的商业逻辑都一样:帮客户用更少的人做更多的事。

Surge AI 让一个销售管理原来需要三个人才能管的客户池。AgencyClaw 让获客效率提升数倍。One-Person Capital 的愿景更极端——一个人就能运转一家小型资本公司。

我对这些产品引以为豪。它们真的解决了客户的问题。

但如果我诚实地面对自己,我必须承认一件事:我在加速莫洛克的运转。

当所有人都有 AI 客户经营工具时,没有任何一个代理人因此获得持久的竞争优势。他们只是被迫在更高的效率基线上,做和以前一样的竞争。而那些学不会或用不起这些工具的人,被直接淘汰出局。

这不是 AI 特有的问题。Alexander 在 2014 年就预见了:技术进步增加了用其他价值换取竞争力的机会。每一次技术革命——从蒸汽机到电脑到 AI——都在做同一件事:扩大了"可以被牺牲的价值"的范围。

蒸汽机让你可以牺牲工匠技艺换取产量。电脑让你可以牺牲人际关系换取效率。AI 让你可以牺牲人类判断力换取速度。

牺牲的东西越来越核心,越来越不可逆。

你的 OKR 就是献祭仪式

如果你在一家科技公司工作,每个季度你都要参加一场仪式。这个仪式叫"OKR 对齐"。

仪式的核心问题是:我们还能优化什么?

表面上看,这是在追求卓越。但 Alexander 的框架让我看到了另一个面:每一个"优化什么"的决定,背后都隐含着一个"牺牲什么"的选择。

- 优化 DAU?牺牲的是用户的时间和注意力

- 优化人效比?牺牲的是冗余和创新的空间

- 优化交付速度?牺牲的是代码质量和技术债务的偿还

- 优化 ARR?牺牲的是长期客户关系和产品深度

不是因为谁邪恶。是因为在竞争环境下,不做这些牺牲的公司会被做了这些牺牲的公司淘汰。

这正是 Alexander 描述的多极陷阱的核心机制:在某个优化目标 X 的竞赛中,出现了一个机会,可以牺牲某个有价值的东西来换取更多 X。抓住这个机会的人繁荣了。没抓住的人灭亡了。

于是整个行业一步一步走向同一个方向:更快、更瘦、更自动化——但也更脆弱、更同质、更没有灵魂。

四道防线,AI 正在逐一突破

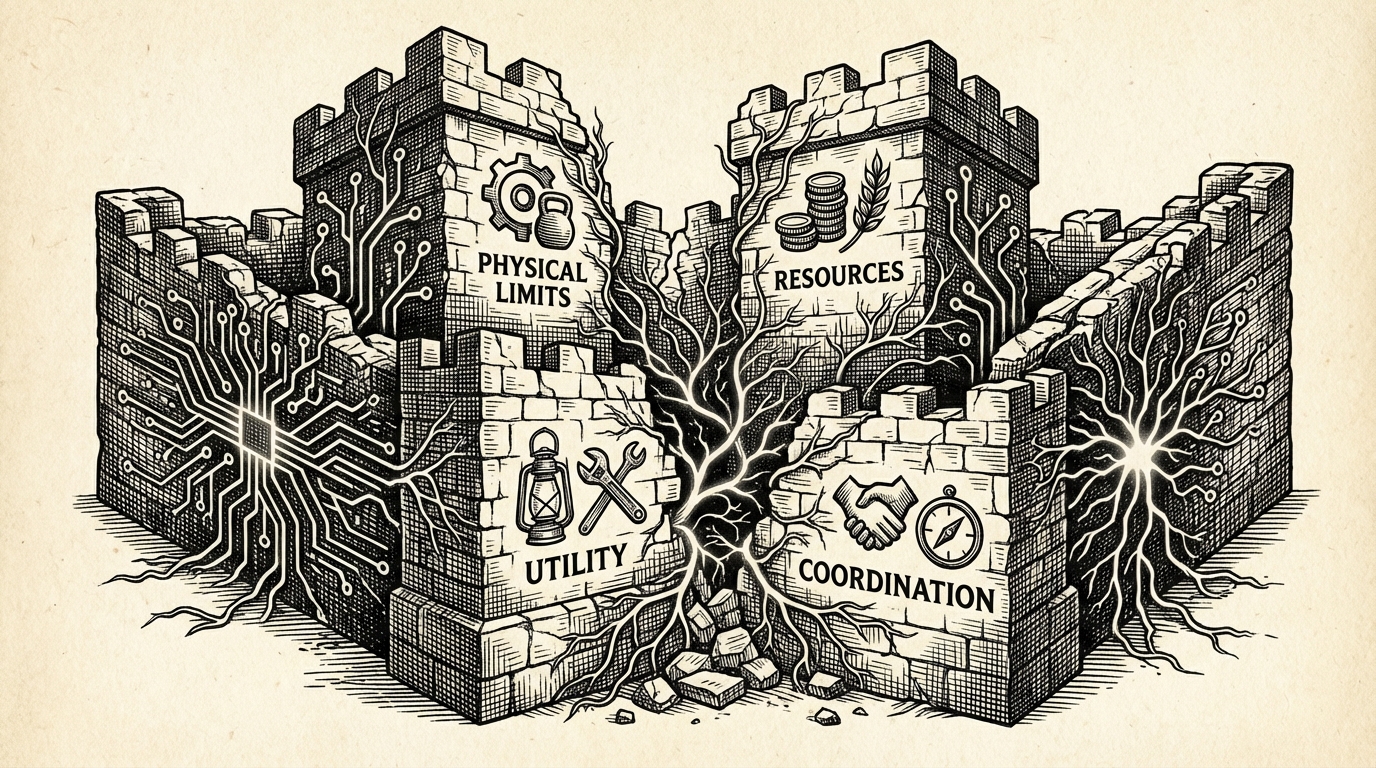

Alexander 在 2014 年指出,人类之所以还没被莫洛克完全吞噬,是因为有四道防线:

第一道:物理限制。竞争受限于物理世界的约束——人需要睡觉、工厂需要原材料、信息传递需要时间。但 AI Agent 不需要睡觉,不需要办公室,不需要社保。物理限制对 AI 来说几乎不存在。

第二道:资源剩余。当资源充足时,竞争不会那么残酷。但看看 2025-2026 年的科技行业:Meta 裁 20%,Block 裁近 40%,Atlassian 砍掉 10%。资源缓冲正在被消耗殆尽。

第三道:效用最大化。人不是纯粹的竞争机器,我们也追求幸福、关系和意义。但在"降本增效"的压力下,这些非竞争性的价值正在被系统性地挤压。

第四道:协调机制。政府监管、行业标准、社会规范——这些都是人类对抗莫洛克的武器。但在"卷"文化里,协调常常被视为软弱,标准被视为束缚,监管被视为创新的障碍。

AI 不是在替代莫洛克,AI 在给莫洛克加速。它正在突破那些曾经保护我们的防线。

那怎么办?一个实践者的思考

读到这里你可能想:那你说怎么办?不做 AI 了?退出竞争?

不。退出竞争不是选项。Alexander 也说了——退出的人只会被吞噬得更快。

但他的文章给了我一个关键启示:问题不在于竞争本身,而在于缺乏协调机制。

囚徒困境之所以是困境,是因为两个囚徒没办法沟通和约束彼此。如果有一个可信的协调机制——比如法律、比如合约、比如共同的标准——困境就可以被打破。

过去一年,我有意识地在我的工作里做了一些"反莫洛克"的选择:

第一,开源。在一个所有人都想建围墙的行业里,开源看起来像是在交出竞争优势。但开源的本质是协调机制——它让参与者基于共同基础竞争,而不是在基础设施层面无限军备竞赛。

第二,建立评测标准。我们做的 AI Agent 评测平台。它的价值不在于排名——排名本身就是竞争。它的价值在于给行业提供了一个共同的度量衡。当所有人用同一把尺子衡量 Agent 能力时,"谁更好"变成了一个可验证的问题,而不是一场比谁更会营销的军备竞赛。

第三,有意识地选择"不优化什么"。这是最难的。在 OKR 会上,我会问一个逆向的问题:"这个季度,我们选择不牺牲什么?"不牺牲产品深度来换速度。不牺牲团队的学习时间来换交付量。不牺牲长期客户关系来换短期 ARR。

这些选择在短期内看起来像是竞争劣势。但如果 Alexander 的框架是正确的,那么真正可持续的竞争力不在于跑得最快,而在于有能力不参与某些赛跑。

最后的问题

Alexander 在文章的最后提出,也许只有一个足够强大的"协调者"——他称之为与人类价值观对齐的超级智能——才能最终战胜莫洛克。

我不知道那一天会不会来。但我知道一件事:

在那一天到来之前,我们每个人都面临一个选择:是无意识地喂养莫洛克,还是清醒地承认自己身处其中,然后在每一个决策点上,有意识地选择少牺牲一点。

下次写 OKR 的时候,试着加一行:

"本季度我们选择不牺牲的东西是——"

如果你写不出来,那莫洛克已经赢了。

参考资料

- Scott Alexander (2014). "Meditations On Moloch." Slate Star Codex.

- Allen Ginsberg (1955). Howl and Other Poems. City Lights Books.

- CNN (2026). "China's AI industry looks unstoppable, but can it overtake the US for tech supremacy?"

- The Wire China (2026). "Scoring the AI Race, a Year after the DeepSeek Shock."