开闭源性能差距的真相:一张跑分榜掩盖了什么

有张榜,大家天天看

打开 Artificial Analysis、LMArena 或者 Hugging Face 的 leaderboard,你会看到一条曲线。开源模型的综合分在追,闭源模型在跑,两者的差距每个季度都在缩小。

Nathan Lambert 这周发了一篇文章,题目叫 Reading today's open-closed performance gap。他说了一句话我认同:现在是他"对 benchmark 的个人信心处在相对低点"的时刻。

这话翻译过来就是——榜单还在更新,但它已经骗不了人了。

我自己做 Agent 产品三年,替很多甲方测过模型。一个反直觉的观察:在跑分榜上分差只有 3 分的两个模型,部署到真实业务里,差距可能是"能用"和"彻底废"的区别。

那张榜藏着什么

先说结论:综合跑分是一个被设计出来安抚用户的数字。它不反映你要做的那件事。

为什么这么说。

一个综合分是由十几个子 benchmark 加权平均算出来的。每个子 benchmark 都在测一个"快照能力"——某个特定任务,某个特定数据分布,某个特定评分方式。把这些快照加起来除以 10,你得到一个"综合智力"的数字。这个数字在模型厂的 marketing 页面上会被放大成标题。

问题是每 12 到 18 个月,前沿的评测重点就会换一轮。

2023 年底,大家比 chat。2024 年上半年,开始比 math。2024 年下半年,coding 登场。2025 年全年,agentic task。到 2026 年 4 月的今天,前沿实验室都在卷什么?RLVR——可验证奖励的强化学习。会计、法律、医疗、运筹,这些需要严格可验证答案的领域。

Lambert 说得直白:Gemini 3 在榜上分数漂亮,但它的 agent 部署量非常有限。为什么?因为榜单测的和企业要用的,已经不是一回事了。

这就是第一层骗局——榜单测的是上一代前沿的问题。

第二层:分布外才是真相

榜单还有一个更隐蔽的毛病:它测的都是分布内(in-distribution)的问题。

什么意思?这些 benchmark 大多是公开数据集。每个模型厂都知道。训练的时候要么直接喂,要么生成一堆类似的合成数据。到真正评测的时候,模型考的是一道自己刷过题的考试。

真正考验模型的是分布外(out-of-distribution)的问题。Lambert 引用了两个跑分:WeirdML 和 ARC AGI 2。这两个榜单刻意在测分布外能力。

结果是什么?综合榜上只有 3 分差距的开源 vs 闭源模型,在 OOD 榜上差距拉开到两位数。

这件事我在产品里反复验证过。我给客户测过一个同时跑开源 Qwen3.6-35B 和闭源 Claude Opus 4.7 的真实场景——多轮客服对话中突然切换到一个从来没见过的小众行业术语。Qwen3.6 在常规问题上分数很漂亮,但一碰到这种切换,它会进入一种奇怪的"自信的胡说"状态。Opus 4.7 会停顿,会反问,会说"我不太确定"。

这两种行为在 benchmark 上的分差可能只有 2 到 3 分。但它们决定了你的产品能不能上线。

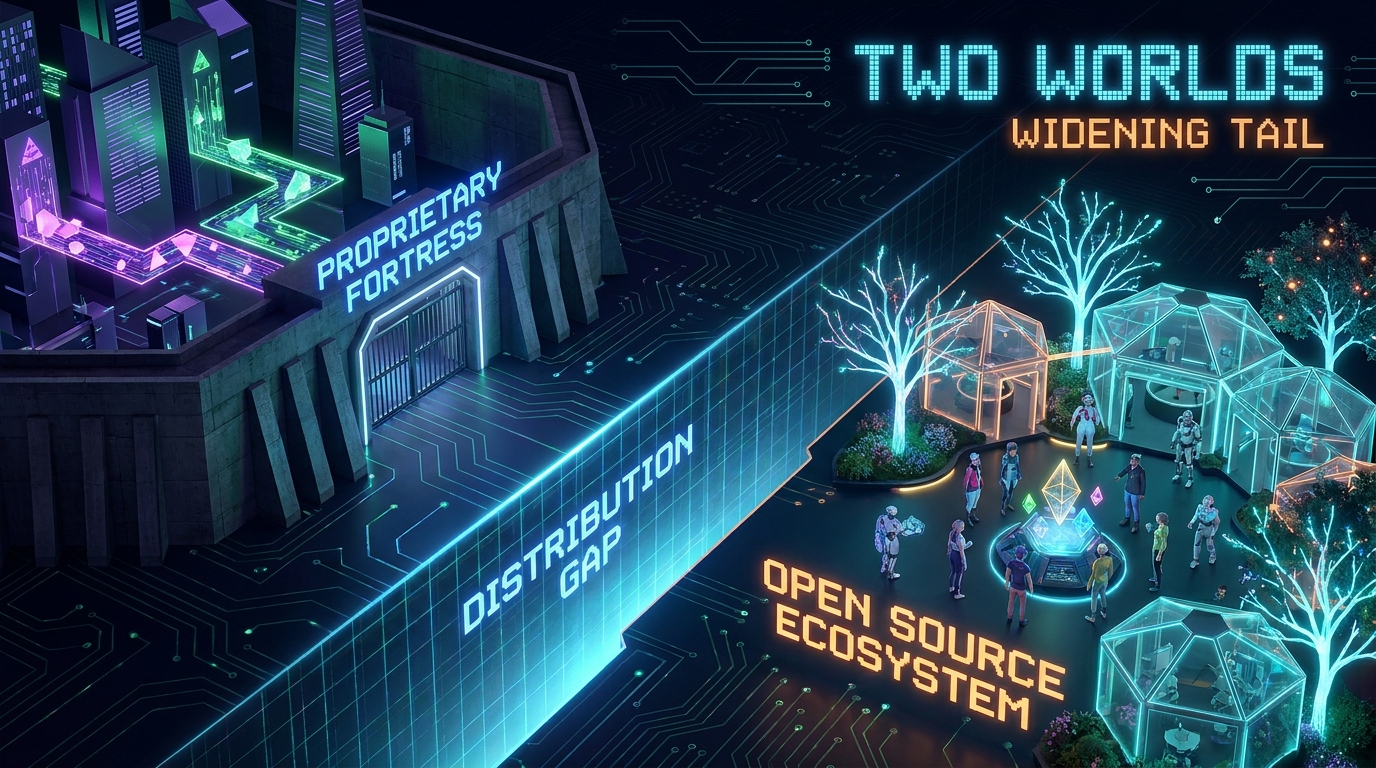

为什么差距还会继续存在

第二个问题更深:前沿实验室有钱有客户,它们会持续保持优势。

这事不需要阴谋论。OpenAI、Anthropic 一年的训练投入是几十亿美元级别。开源社区能组织起来的算力和数据是两个数量级以下的东西。在 benchmark 上开源能追上,是因为 benchmark 是公开的、有限的、可针对性优化的。

但前沿实验室接下来要解决的问题——比如 RLVR 在会计、法律上的落地——需要的是垂直领域的专有数据和反馈循环。这些东西不公开。Anthropic 和 KPMG 签合作,OpenAI 和 PwC 签合作,不是因为它们需要咨询服务,是因为它们需要真实的企业问题作为训练信号。

开源模型在综合跑分上咬得再紧,拿不到这些封闭的反馈循环,就永远追不上闭源在具体垂直任务上的表现。

反过来想。如果 agentic coding 这种公开可测的能力真的饱和了,前沿实验室的护城河在哪?在客户关系、在专有数据、在已经部署在客户内网里的服务。不在模型本身。

这就是我说的——benchmark 这场游戏已经越来越没意思。它测的是一个快速商品化的东西。前沿的战争已经不在这张榜上。

中国实验室的博弈

Lambert 文章里一句话值得展开:中国实验室显得比欧美更关注 benchmark。

我理解这件事。对于 Qwen、DeepSeek、Kimi 这些团队来说,跑分是叙事资本。他们需要在一张全球通用的榜单上告诉世界"我们没落后"。

这个选择本身没错,但代价是——他们的产品化速度会更慢。因为他们把资源压在了对 benchmark 最优的训练配方上,而不是压在真实的企业反馈循环上。

你看 Qwen3.6-35B 的发布稿,会发现它列了一堆编程 benchmark 的数字。但如果你去问一个真在用它做生产部署的团队,得到的反馈往往是"在某些边界场景下不够稳"。不是模型不好。是优化目标和使用目标之间有偏差。

这个偏差,闭源模型靠企业客户的真实使用反馈去弥补。开源模型目前还没有同等规模的反馈来源。

对企业选型的实际建议

那对我这样要做选型的人,这张榜还有用吗?有,但用法要变。

第一,别再看综合分。看子榜,看和你业务最接近的那几个。客服类看多轮对话 benchmark,代码类看 SWE-bench 和 CursorBench,Agent 类看 MCP-Atlas 和 AgentBench。

第二,做自己的小 eval。拿你业务里最近一周真实出现的 50 个 query,让候选模型跑一遍,人工打分。这个小评测比任何公开 benchmark 都重要。

第三,注意长上下文和稳定性。Opus 4.7 1M context 召回率从 4.6 的 78.3% 掉到 32.2%,这种退化在综合跑分上看不出来,但它会毁掉你的 RAG 产品。

第四,别迷信"最新发布"。新模型往往有 hidden regression,让子弹飞两周再上生产。

三个可转发的金句

跑分榜测的是上一代前沿的问题。它更新很快,但永远落后一拍。

开源和闭源的差距,不在综合分,在分布外。

Benchmark 饱和的那一天,前沿实验室的护城河不在模型,在客户数据。

Arthur 是一名在 AI Agent 产品一线做了三年的建设者。这篇写给准备做模型选型的同行。