开源模型不是在追赶 GPT,它们在建另一条流水线

Nathan Lambert 前几天更新了 ATOM Report — 他维护的那份追踪开放语言模型生态的技术报告。这次更新里他塞了一个新指标,叫 RAM(Relative Adoption Metric,相对采用率)。逻辑很简单:一个模型在某个时间点上得分 >1,意味着它"正在"成为全网下载量前十的模型。

我盯着这个指标看了一会。它说的是一件非常刺耳的事。

大家都在讨论错的东西

闭源阵营的粉丝爱聊"GPT 比开源强多少"。开源阵营的粉丝爱聊"我们追上 GPT 了吗"。这两拨人都默认了一个前提:闭源和开源跑的是同一条赛道,测的是同一套指标,终点是同一个。

错了。

Nathan 的 RAM 指标测的不是"谁更聪明",是"谁正在被真正使用"。Gemma 4 的早期采用数据是"incredible",GPT-OSS 的 RAM 走势、中国中段玩家(Moonshot、Z.ai、MiniMax)的推理市场份额,是他这次报告真正的信号。能力分数榜上这些模型不在顶端,它们在另一个位置 — 在"被部署"这条轴上。

"追赶 GPT" 是一个非常具有误导性的叙事。它假设开源的目标是做出一个和 GPT-5.4 一样好的模型。没人(或者说,严肃做开源的人)真的这么想。开源在做的是另一件事:把 AI 能力从"访问 API"这个瓶颈里解耦出来。

我的视角:开源模型最痛的不是智力

讲一下我为什么在意这件事。

我带的几个产品(企业 AI 经营管理平台、获客 Agent、开源的 Agent 编排框架),用开源模型做过深度集成。三年下来,我最清晰的一个判断是:开源模型不如闭源的地方不是智力,是生态成熟度。

举个具体的:我给银行客户做一个对话式报表 Agent。用 Claude Sonnet 跑,接好 tool use、流式输出、多轮上下文管理,两天搞定。换成一个开源 MoE 模型,同样的功能要折腾两周 — 不是模型不聪明,是它的 tokenizer、serving 栈、tool-calling schema、流式协议都要自己凑。每一个点都差那么一点点,合起来就是一个月。

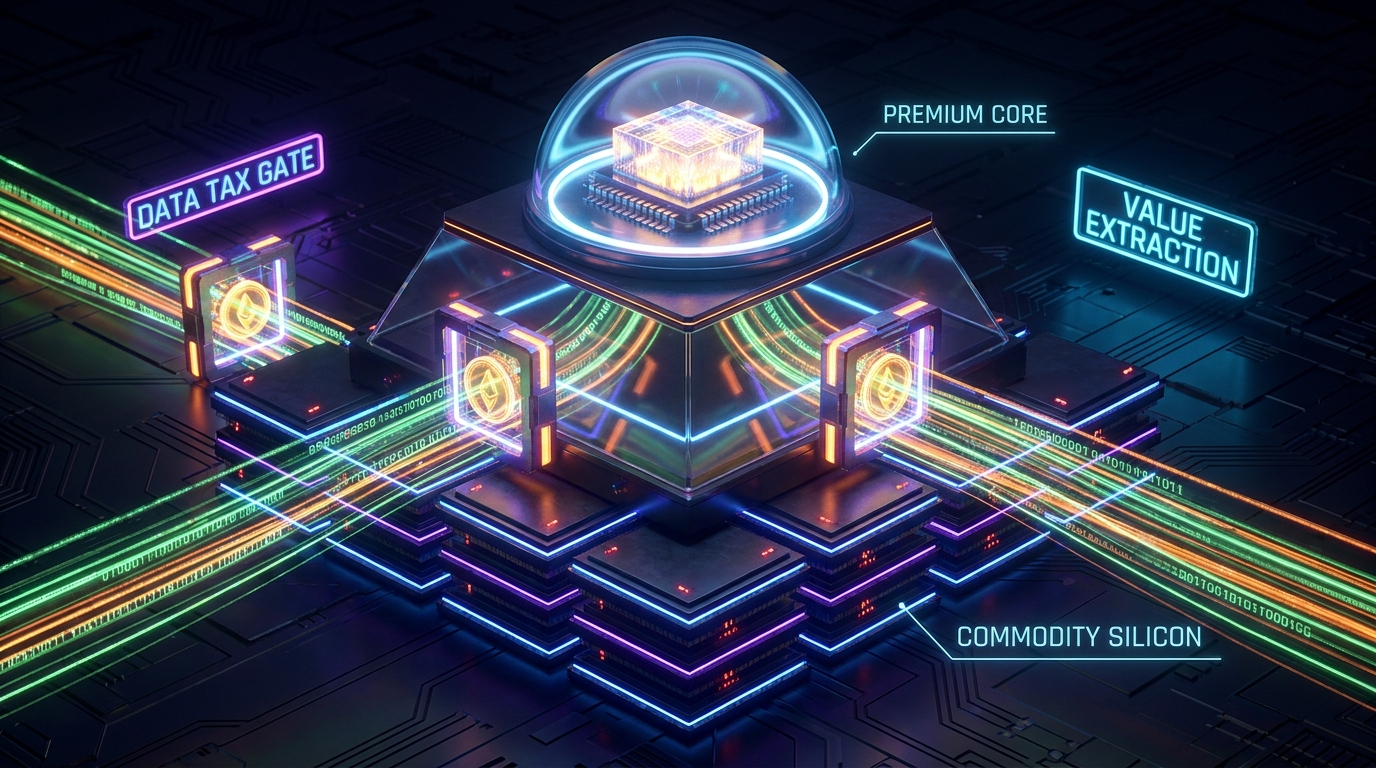

闭源模型的护城河不是"GPT 比开源聪明 10%"。是 OpenAI、Anthropic 把"模型 + 工具调用协议 + 推理栈 + 计费 + 监控"一次性打包卖给你,你只要对着 SDK 写几行就能跑。你付的那个 per-token 费用,一部分是智力租金,更大一部分是集成税。

开源在做的,不是让模型变得更聪明。是让这些集成税的每一层都变得可替换。

中国中段玩家正在变成基础设施

Nathan 报告里提到的 Moonshot(月之暗面)、Z.ai(智谱)、MiniMax,是三家典型的"中段"公司。能力上它们不如 Claude Opus 4.7 或 GPT-5.4。但在 inference 市场份额上,它们正在变成某种默认底层。

为什么?因为它们做对了一件事:它们的模型权重、serving 容器、tokenizer、tool schema 都是标准化的。你可以在自己的 GPU 上跑 Qwen3.6、Kimi K2,也可以在阿里云、字节火山引擎、Together AI、Fireworks 上一键切换。模型是同一个,只是部署位置变了。

这在闭源里不可能。你用 Claude 就只能走 Anthropic(或 AWS Bedrock/GCP Vertex 的转售通道),价格、速率、审计、合规全部由它定。你从 GPT-4 切到 Claude 得改 prompt、改 tool schema、改错误处理。每一次切换都是一次伤筋动骨的迁移。

开源模型把这一层变成了商品。你要跑 Qwen,你挑任何一家有 GPU 的供应商都行。中国中段玩家不是在造新的 GPT,它们在造可以被任何人部署的"模型型号"。就像 Intel 的 x86 指令集一样 — 你不需要 Intel 这家公司存在,你只需要这套指令集被到处支持。

这是一条和闭源完全不同的流水线。闭源卖的是"访问",开源卖的是"标准"。两者最终都会有用户,但用户付钱的理由不一样。

"open-closed gap" 被误读了

Nathan 在他的另一篇博客(《My bets on open models, mid-2026》)里反复提到"open-closed gap"。大多数人理解这个词是在说能力差距。

我的判断:真正的 gap 不在能力,在分发。

闭源模型的分发是单点的 — API。你要用 GPT,就得接 OpenAI 的 API,走它的速率限制、它的定价、它的审查、它的区域可用性。这是一个极端脆弱的分发结构。任何一个中断(API 挂了、封号、定价变化、区域下架),整个下游全部停摆。

开源模型的分发是多点的。Hugging Face 有一份、ModelScope 有一份、用户本地硬盘有一份、企业私有部署有一份。每一份都可以独立跑。封号对它无效,价格战它可以跟,地缘断供它有冗余。

这个差距是结构性的,不是一次模型升级就能补。Claude 再做得好,它依然是一个单点分发的商品。Qwen 再做得差一点,它天然是多点分发的基础设施。

我们做企业 AI 产品,最怕的就是"单点依赖"。一个银行客户问我:"你们的 Agent 如果 Anthropic 明天不做中国业务了怎么办?"我没法回答他,因为答案是"那我们就完蛋"。这种问题问开源模型就没有 — "Qwen 如果阿里云下架了怎么办?" "那我在字节、腾讯、自己机房都能跑。"

对 CIO 来说,这不是成本问题,是风险问题。RAM 这个指标之所以重要,是因为它第一次量化了开源模型作为基础设施的采用速度,而不是它们作为"候补选手"的追赶速度。

闭源阵营其实也明白

有意思的是,闭源阵营自己也开始意识到这点。GPT-OSS 的发布、Anthropic 越来越开放的 Claude Code(代码虽然有,但核心逻辑短时间内不会开源),都是在往这个方向妥协。

闭源不是不懂"多点分发"的价值。它是被商业模式锁住了。OpenAI 和 Anthropic 的估值依赖"每一次调用都收钱"这个结构。一旦模型权重公开,这个结构立刻崩塌。

所以闭源会做两件事:一是继续拉开前沿能力差距(Claude Opus 4.7、GPT-5.4 这些),靠"能力溢价"维持单点分发的合理性;二是选择性开源那些已经过时的版本(GPT-OSS 基本是 1-2 代前的水平),满足一部分场景但不动核心商业模式。

这个策略能不能撑住,取决于一个问题:能力溢价能撑多久?

Dwarkesh 前几天的一篇学习笔记算了一笔账 — 蒸馏出一个 Opus 4.6 级别的模型,大概需要 2500 万美元的 API 调用。听起来很多,但如果你是字节、阿里、甚至 Meta,这笔钱小到可以忽略。前沿能力的"租金期"正在被技术扩散压缩。

我的预判

三年内会发生三件事:

- 开源模型在 60% 以上的企业场景里变成默认选项。不是因为它更聪明,是因为它可替换、可审计、可本地化。

- 闭源模型退守到"前沿一年内"的窗口。超过这个窗口,它的能力溢价不足以覆盖集成税。

- "模型型号"会像 x86 一样标准化。Qwen 格式、Kimi 格式可能会合并成 2-3 个事实标准,任何 serving 供应商都支持。

- Nathan Lambert, What I've been building: ATOM Report, post-training course, finishing my book. Interconnects.ai, 2026-04-14.

- Nathan Lambert, My bets on open models, mid-2026. Interconnects.ai, 2026-04-15.

RAM 这个指标现在还是给 geek 看的。三年后它可能会变成 CIO 做采购决策的默认依据。

顺便说一句,Nathan 的 RLHF Book 印刷版快出了,5 月左右上市。我打算买一本送给我们技术团队。不是因为它是圣经 — 是因为这本书让一代从业者第一次有了可以共同指代的语言。这比任何一个具体的模型都更有复利。

一个遗留问题留给你:如果开源模型变成基础设施,那"模型公司"作为一个商业实体还值不值得存在?Hugging Face、Together、Fireworks 这些做 serving 的会不会吃掉 OpenAI 的午餐?我的判断是 — 会,但没那么快。理由下次写。

参考资料: