OpenAI 给安全圈发了张白名单:AI 护栏的特权时代正式开始

OpenAI 这周扔出来一个叫 GPT-5.5-Cyber 的东西。

新闻稿写得很温和:扩大"可信访问"项目,帮助经过验证的防御方加速漏洞研究、保护关键基础设施。中文世界几乎没人写。AI 行业的注意力还在 Anthropic 的 80 倍增长、GPT-Realtime-2 这些更显眼的话题上。

但这个看上去不起眼的产品发布,藏着 AI 行业三年来最重要的一次转折。

护栏第一次按身份分级了

过去三年里,AI 公司给所有人提供的是同一套规则:对一个不认识的医学研究员、对一个匿名的高中生、对一个在野渗透的红队工程师,模型的回答策略是统一的。

这套机制有个隐含前提:我假设我面前的每一个用户都可能是潜在恶意者,所以我把所有人当嫌疑人对待。

GPT-5.5-Cyber 把这个前提扔了。它说:来,先证明你是谁,证明完了,我可以给你看更多的工具。

这不是一次模型更新。是 AI 工具进入"特权时代"的第一声枪响。

分级护栏的事实形态

OpenAI 的 Trusted Access for Cyber 项目本身不是新东西,但 GPT-5.5-Cyber 第一次把它和"同一个模型权重,按身份开放不同能力边界"这件事直接绑定。

具体怎么分?

- 公开版 GPT-5.5:所有人都能用,但拒绝大量"灰色地带"请求——比如一个具体 CVE 漏洞的利用链拆解。

- Trusted Access 通过验证的防御方:可以请求漏洞识别、补丁验证、恶意软件解析。

- 最高等级(GPT-5.5-Cyber):拿到护栏更松的版本,能做漏洞挖掘、恶意样本研究、攻击逆向。

但有些事永远不开:写恶意软件、盗凭证。这是底线。

形象点说:你之前推开的是商场大门,看到的是同一个货架。现在 OpenAI 在大门内加了一道身份检查,验证完了你被领到楼上的"VIP 区",那里有以前看不到的东西。

关键不是"开放了什么新功能",而是第一次有头部公司公开承认:AI 公司有能力、也愿意按身份分配能力。这个能力以前是隐性的——每家大模型公司都有内部白名单给政府、军方、大型安全厂商,但谁都不公开承认。GPT-5.5-Cyber 把它做成了显性产品。

为什么必须分级?

把护栏统一应用到所有人身上,看上去公平,其实低效。

问题在哪?两端都漏。

正经研究者那一端漏了。一个安全公司的红队工程师想用 AI 帮他理解一个新发现的反序列化漏洞,模型拒绝深入讨论。他骂一句然后切换到本地跑的开源模型,问题解决。结果是:能帮防御方的工具被自家护栏挡住,但攻击者照样有路径。

有动机的攻击者那一端也漏了。真心想造恶意软件的人不会去用 ChatGPT。他们用越狱过的开源模型、本地部署的小模型、各种灰色 API 中转。OpenAI 拒绝他们一万次,他们也照样能拿到工具。

把护栏均匀涂在所有用户身上的结果是:它对真正想做坏事的人几乎没有约束力,但对正经做研究的人造成了持续摩擦。

更深一层:AI 能力本身不分善恶,只有使用者的语境分善恶。同一段化学知识,给医药研究员是合成路径,给恐袭分子是化武说明书。同一段反汇编分析,给红队是漏洞研究,给黑产是攻击武器。

所以唯一可能起作用的护栏,是根据"你是谁"来决定"模型给你看什么"。

OpenAI 的算盘是:与其守一道虚假的统一防线,不如承认现实,公开建立一个身份验证 + 分级开放的体系。验证过的人多一点权限,验证不过的人少一点风险。

但这个权力,凭什么交给一家公司?

这是这件事最尖锐的问题。

OpenAI 凭什么决定"谁是好人"?凭它收的 ID 验证材料?凭它定义的 Trusted Access 标准?凭它和某些政府机构、某些大型安全厂商的私下沟通?

这些都不是公开透明的标准。

但更现实的回答是:这个权力本来就在 OpenAI 手里,只是过去隐性。

每家大模型公司都有内部白名单。区别只是 GPT-5.5-Cyber 第一次把这件事做成了一个公开的、可被讨论的产品。

把隐性的特权显性化,至少多了一个好处:它进入了公共审视的视野。哪些人能进白名单?审核标准是什么?滥用了怎么办?这些问题以前你连往哪问都不知道,现在它有了一个名字、一个产品页、一份 AISI(英国 AI 安全研究所)的公开评估报告。

这不是好事,但比"假装平等"诚实。

双轨时代正式开始

GPT-5.5-Cyber 释放的真正信号,不是网络安全圈多了一个工具。是 AI 行业三年来"我们对所有人一视同仁"的叙事正式宣告破产。

未来 18 个月,大概率会陆续看到:

- 生物医药版:解锁更详细的药物合成讨论,给制药公司、学术机构。

- 金融版:解锁更深入的风控/反洗钱建模讨论,给银行、监管。

- 法律版:解锁更激进的诉讼策略推演,给律所。

每个垂直行业都会有自己的"Trusted Access"。能进这个名单的公司和个人,将用到一个和普通人不一样的 AI。

这对国内大厂是个挑战。Anthropic 和 OpenAI 都在走"挑边站"的路线——明确给经过认证的防御方更大的工具空间,是一种主动的产业立场。国内大厂的传统姿态是"工具中立、服务所有客户",这个姿态在通用 LLM 时代还能维持,但当能力进一步分级时,"我对所有人一视同仁"会变成竞争劣势——好的研究者会去能给他们更多权限的平台。

更现实的问题给到所有 AI 产品建设者:当你的工具足够强大时,你迟早要决定,把它给谁、不给谁。装作工具中立是一种偷懒。做 AI Agent 产品的过程里,每一次"这个能力放给所有用户、还是放给付费用户、还是放给企业版"的决策,本质都是这件事的微缩版。

OpenAI 这次只是把它做大了,做公开了。

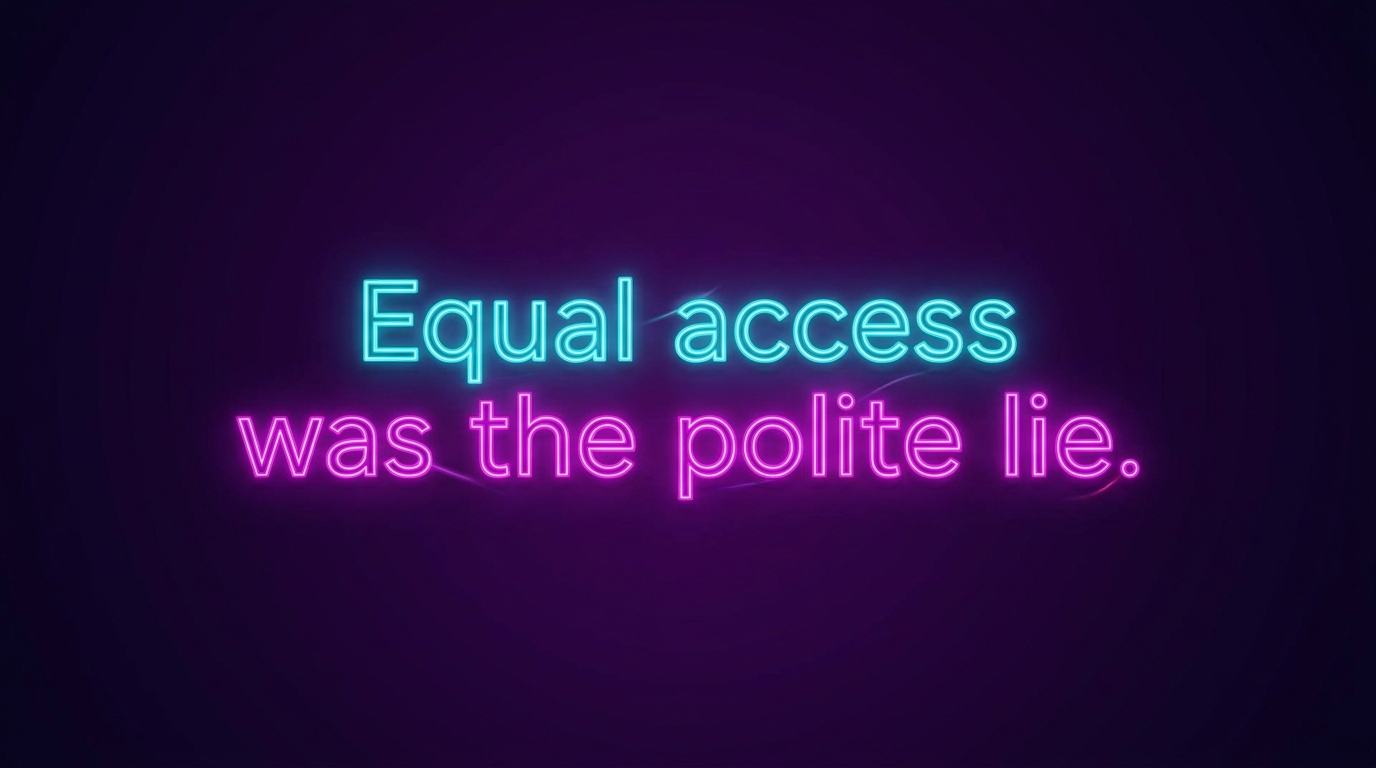

过去三年,AI 公司假装它对所有人都一样。

GPT-5.5-Cyber 是它们第一次承认——

它一直在挑边站。

只是这次,挑得明明白白。