Opus 4.7 不再卖聪明:推理竞赛悄悄结束了

# Opus 4.7 不再卖聪明:推理竞赛悄悄结束了

4 月 16 日,Anthropic 发布了 Claude Opus 4.7。

很多人把它读成又一次升级:SWE-bench Verified 从 80.8% 跳到 87.6%,SWE-bench Pro 拿下 64.3%,把 GPT-5.4(57.7%)和 Gemini 3.1 Pro(54.2%)甩开一个身位。

我看到的却是另一件事。

Opus 4.7 是第一个公开放弃"更聪明"这个卖点的前沿模型。它不是 IQ 暴涨的版本。它是行业集体转弯的那一刻。

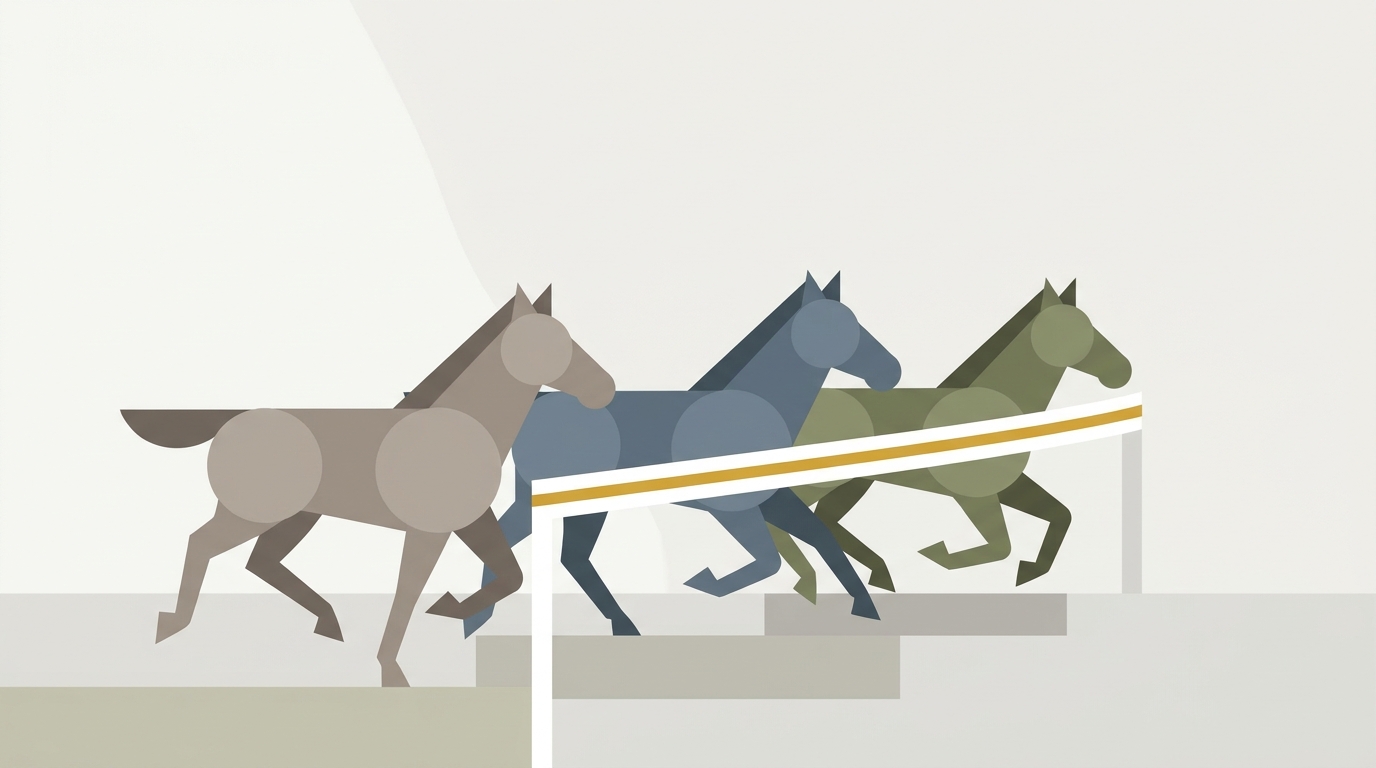

一、GPQA 三家并列,推理军备竞赛第一次没了赢家

请注意这一组数字:

| 模型 | GPQA Diamond |

|---|---|

| GPT-5.4 Pro | 94.4% |

| Gemini 3.1 Pro | 94.3% |

| Claude Opus 4.7 | 94.2% |

差 0.2 个百分点。三家差距全部落在评测噪声范围内。

GPQA Diamond 是什么?是博士级科学推理题集。2023 年 11 月的水平是 39%,2024 年 9 月 o1 模型 77%,2025 年 7 月 92%。从 39 到 94,只用了不到 30 个月。

现在走不动了。Epoch AI 的研究者说得直白:benchmark 在前沿顶端已接近饱和,任何增量都会非常小。

前沿模型撞到了天花板——不是技术的天花板,是这个具体赛道的天花板。

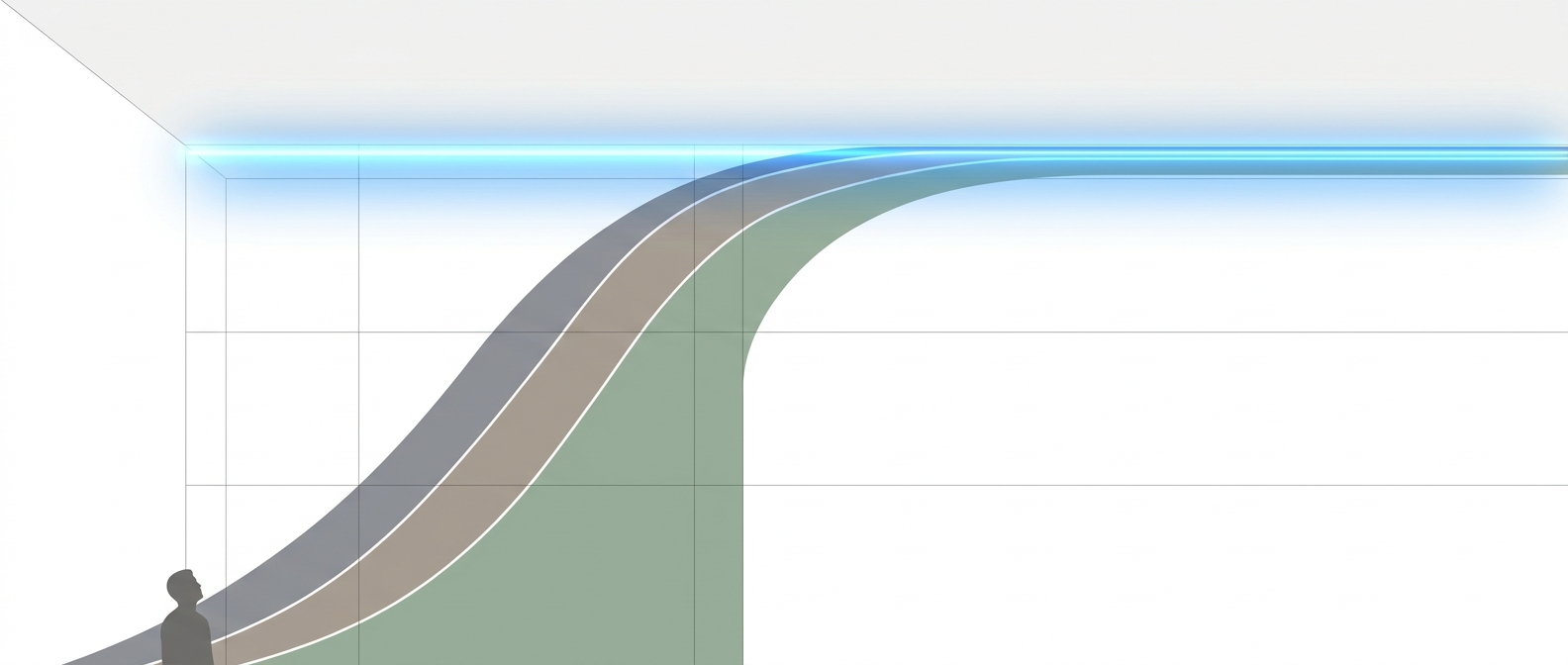

过去三年,每一代旗舰都靠"推理跃迁"当头条:o1、o3、Gemini 2.5、Claude 4、Opus 4.5。从 GPT-4 到 Opus 4.7,那根向上的曲线第一次在顶端趋平。

这不是一次发布,这是一场葬礼。二、Anthropic 和合作伙伴的话术,整齐得像串通过

看 Opus 4.7 的官方话术和合作伙伴引语:

- Anthropic:模型"被设计来在数小时长的工作流里保持专注"

- Cognition(Devin):"works coherently for hours,能在难问题上持续推进"

- Vercel:"开始写代码之前会先对系统代码做证明"

- Intuit:"在规划阶段就抓住自己的逻辑漏洞"

- Factory:任务成功率提升 10-15%,半途卡住的情况更少

你注意到什么没有?没有一句在讲"更聪明"。

全部在讲一件事:毅力、一致性、长时程不走神。

三年前卖 IQ,现在卖 EQ。不,准确说,是卖"注意力耐力"——能不能一边做事一边不忘事,能不能连续 8 小时不崩溃,能不能先自证再动手。

市场话术的整齐反转,是产业信号。旗舰模型们已经私下换了 KPI。

三、Opus 4.7 自己就是专业化的证据

如果 Opus 4.7 是"更强一点的 Claude",它应该全线领先。实情不是。

- SWE-bench Verified:87.6%(全场最高)

- SWE-bench Pro:64.3%(全场最高)

- CursorBench:70%(一跃领先)

- OSWorld-Verified:78.0%(领先 GPT-5.4 的 75%)

- Terminal-Bench 2.0:69.4%(输给 GPT-5.4 的 75.1%)

同一次发布,同一组评测,Opus 4.7 在"改仓库代码"上领先,在"开 shell 跑终端"上落后。

这不是 bug,这是定位。

Anthropic 押注长时程代码 agent这条赛道——多文件、多步、有计划、能自我纠错。代价就是放弃 Terminal-Bench 这种以短指令为核心的评测。

过去我们挑模型是"谁更聪明"。从今天起,挑模型是"谁的专业方向和我对得上"。

通才冠军时代结束了。还有更硬的证据。Anthropic 在训练 Opus 4.7 时,刻意调低了它的网络安全能力。这在前沿模型发布史上是头一次——不是"我们只能做到这么强",而是"我们故意让它在这个方向不那么强"。

因为 Anthropic 手里还捏着一个没发布的模型:Mythos Preview。那个模型在过去几周里找出了 OpenBSD 里存活 27 年的远程崩溃漏洞、FFmpeg 里 16 年没人发现的老洞、Linux 内核里能把普通用户权限升到完全控制的漏洞链。它的 API 价格是 $25/$125,是 Opus 4.7 的整整 5 倍。

所以这次发布的真相是:Opus 4.7 不是"最聪明的 Claude"。它是被有意塑形过的——砍掉一块能力(cyber)、加强另一块能力(长时程代码 agent),配上护栏对外推。

这彻底坐实了我的观点:前沿模型不再按"最大 IQ"卖,它们按"定向配置的能力形状"卖。

四、价格不变是最诚实的信号

Opus 4.7 定价保持 $5/$25(输入/输出 per million token)。

读起来像利好。其实不是。

两件事叠加:

1. 全行业推理天花板逼近,新版本的"质量增量"不再值得涨价

2. Opus 4.7 换了新 tokenizer,同样文本最多多吃 35% 的 token

等于一次隐形的 35% 涨价,但包装成"价格不变"。这个信号比 benchmark 更值得读。它说的是:前沿模型的能力,正在从通用底座,流向特定方向的专项。通用能力不再值得多收钱,专项能力才是产品。

你买的不再是"更高分的模型",你买的是"对你任务更对口的模型"。

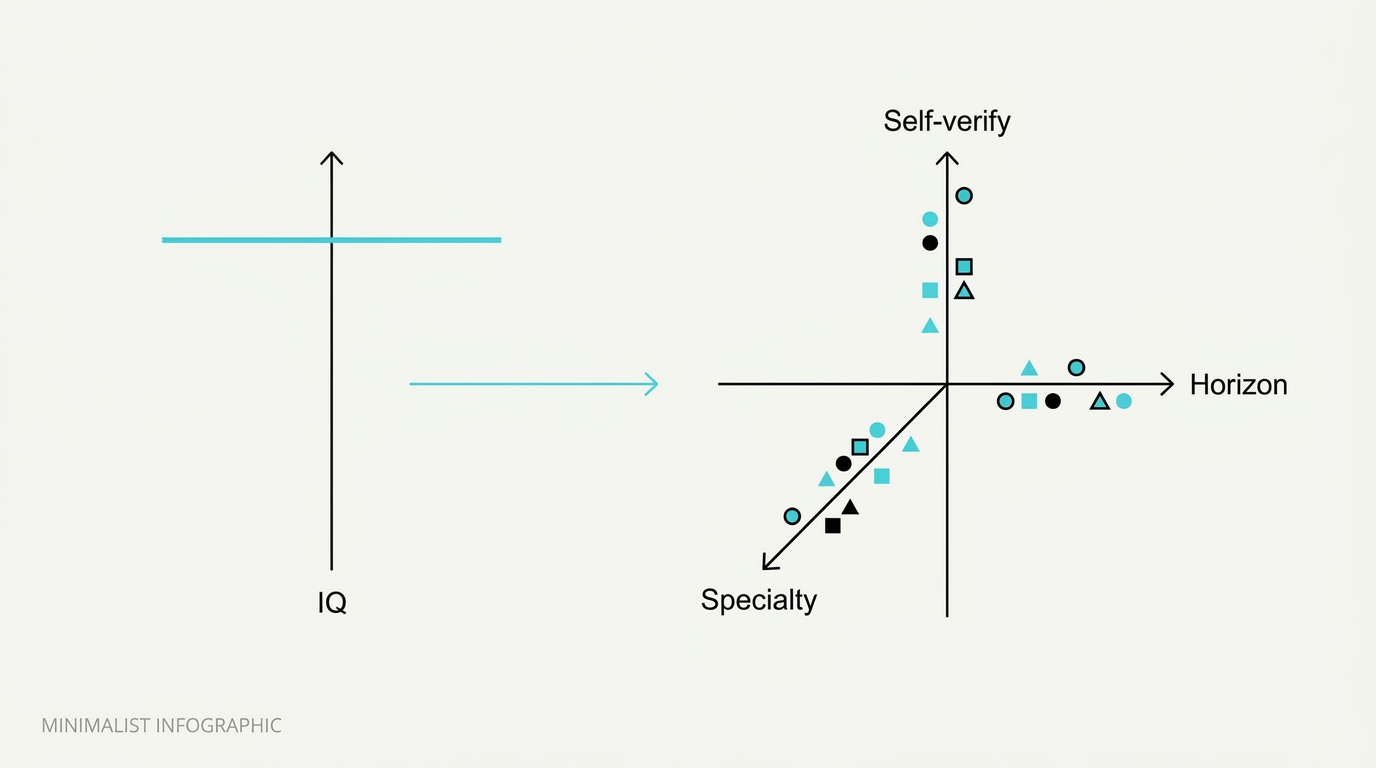

五、从 IQ 轴到 Grit 轴:选型框架要换了

我自己交付 AI Agent 产品这几年,有个反直觉的体会:客户问题的天花板,极少是模型不够聪明。

它几乎永远是模型在 40 步之后开始忘了第 3 步说过什么。是代码 agent 改了一个文件之后不记得还有 5 个关联文件。是规划阶段漏了一个边界条件,到执行阶段才崩。

这些都不是 IQ 问题,是 grit 问题——持续性、一致性、自我校验。

看 Opus 4.7 早期客户报告的数据点就很清楚:Notion 说工具调用错误从 Opus 4.6 降到三分之一;Rakuten 在自己的 SWE-Bench 上解决的生产任务是 Opus 4.6 的 3 倍;Imbue 直接让 Opus 4.7 从零自主搭了一个 Rust TTS 引擎——神经网络、SIMD 内核、浏览器 demo 全写完,然后反过来用语音识别器验证输出对不对。

这些数据全部在讲 grit,没有一个在讲 IQ。

同步发布的还有一个小细节值得注意:Claude Code 默认 effort 拉到了一个新档位 xhigh(比原先的 high 更高、比 max 更低)。这意味着"让它思考多久"变成了可调刻度。耐力本身成了明码标价的商品。

Opus 4.7 的真正信号是:整个行业终于承认了这件事。

所以从今天起,模型选型的问题变了。

不要再问 "哪个更聪明"。问这三个:

1. 它在我这条任务链上能跑多长不崩?(长时程一致性)

2. 它错了之后能不能自己发现?(自证能力)

3. 它的专业化方向和我重合吗?(Opus 4.7 擅长代码 agent,GPT-5.4 擅长终端和速度,Gemini 擅长超长上下文和成本)

这是三条独立的轴。没有一个模型在三轴都领先。

选型从"挑冠军"变成了"配方向"。

选型从"挑冠军"变成了"配方向"。

六、为什么这件事比"SWE-bench +7 分"重要得多

SWE-bench 涨 7 分,是产品层事件。

推理军备竞赛结束,是产业层事件。

它意味着:

- 下一代旗舰不会再靠 "IQ 震撼" 发新闻。新闻点要么是长时程、要么是成本、要么是专项突破

- 模型间"碾压式差距"时代过去了。差异化取代等级化

- Agent 产品的真正护城河,从 "用了最聪明的 Claude" 变成 "选对了适配自己任务链的模型 + 工程基础设施稳不稳"

我做 Agent 产品时最贵的 bug,从来不在 benchmark 分数里。它们在 token 膨胀里、在第 7 步的状态丢失里、在 agent 绕开了人的工具调用回路里。

Opus 4.7 把行业的视线从"天花板多高"拉到了"地基多稳"。这比那几个跑分数字值钱得多。

收尾

Opus 4.7 发布当天,几乎所有人都在刷 SWE-bench Pro 64.3% 领先 GPT-5.4 的图。

我建议你忘了那张图。

真正要存档的是另一张图:GPT-5.4 Pro 94.4、Gemini 3.1 Pro 94.3、Claude Opus 4.7 94.2。

三家平手,推理竞赛悄悄结束。

下一页,开始比谁更有耐心。

参考数据:Anthropic 官方发布与 System Card、Project Glasswing 公告、Epoch AI GPQA 追踪、Vellum AI benchmark 分析、GDPval-AA 榜单(Artificial Analysis)、合作伙伴(Cognition/Vercel/Intuit/Factory/Notion/Rakuten/Imbue/XBOW)发布日数据。