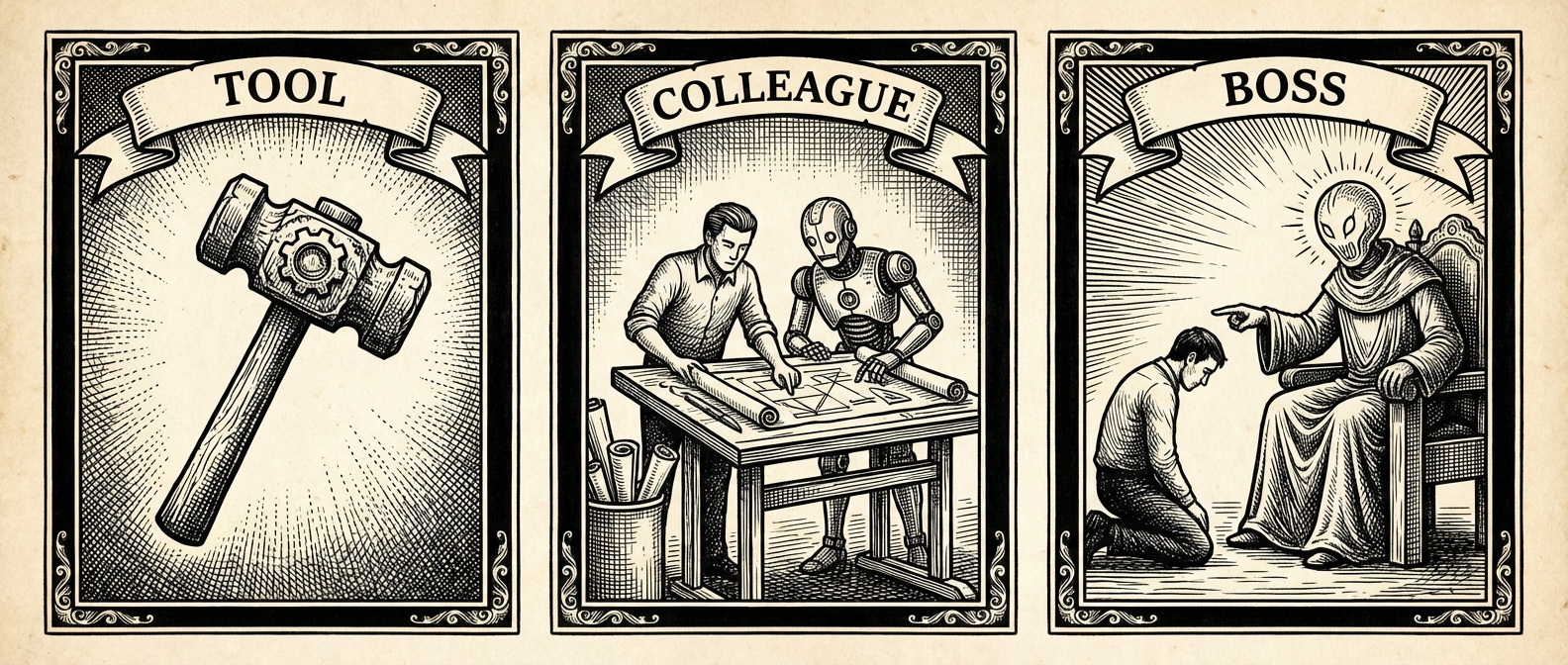

AI Agent 三年推演:从工具到同事到老板

预测未来最好的方式不是读论文,是部署产品。每一次上线失败都比一百篇预测文章更有信息量。

一篇让我停下来的预测文章

2025 年,AI Futures Project 发布了一篇长文:AI 2027: What Superintelligence Looks Like。作者 Daniel Kokotajlo 是前 OpenAI 研究员,因为对 AI 安全的担忧而离职。他写了一个逐年推演的剧本:2025 年 AI 成为顶级程序员,2026 年 AI 开始自主做研究,2027 年超级智能出现。

这篇文章在技术社区引发了巨大反响。支持者说它是"最严肃的未来预测",反对者说它是"末日论的精装版"。

我的反应和两边都不一样。我的反应是:他说的很多东西,我已经亲眼见过了。有些他说对了,有些他完全没料到。

过去三年,我从零到一造了七个以上的 AI Agent 产品。我不是在读论文推演未来——我是在生产环境里看着这些 Agent 上线、翻车、重构、再上线。

这篇文章不是对 Kokotajlo 的反驳,也不是对他的验证。这是一个实践者的校准:拿三年的部署经验,去对照一份技术社区最认真的预测,看看裂缝在哪里。

阶段一:工具(2023—2024)——他说对了,但低估了摩擦

Kokotajlo 的剧本里,2025 年 AI 已经是"顶级程序员"。他描述了一个叫"Agent"的系统,能在几小时内完成人类工程师需要一周的编码任务。

从纯能力的角度看,他的时间线大致正确。2023 年到 2024 年,我们确实看到了 AI 编码能力的指数级提升。GPT-4 发布时我们的团队第一次感到震撼:这东西写的代码,至少在局部质量上,已经和中级工程师差不多了。到了 2024 年底,Claude 3.5 和 GPT-4o 的出现让编码 Agent 成为真正可用的工具。

但 Kokotajlo 遗漏了一个关键变量:部署摩擦。

我在 2023 年就开始做 Surge AI——一个面向销售管理的 AI Agent 产品。理论上,大模型已经能理解客户需求、生成回复、做基本的策略推荐。实际上,从"大模型能做到"到"产品上线不出事"之间,有一条巨大的鸿沟。

第一个坑:幻觉。 Agent 在给客户生成建议时,会编造不存在的产品特性。这在实验室里是个"有趣的局限";在生产环境里,这是合规事故。我们花了两个月建造事实校验层,把每一条输出和知识库做交叉验证。这不是算法问题,这是工程问题。Kokotajlo 的剧本里没有工程问题。

第二个坑:上下文碎片化。 客户的信息分散在 CRM、聊天记录、邮件、会议纪要里。Agent 需要把这些碎片拼成一个连贯的客户画像。2023 年的上下文窗口太小,塞不下;2024 年窗口大了,但检索精度又不够。我们前后迭代了四版 RAG 架构才勉强达到可用水平。

第三个坑:信任。 用户不信任一个会犯错的 AI。哪怕错误率只有 5%,用户也会说"我还不如自己来"。这不是技术问题,这是心理学问题。我们最终的解决方案不是提升准确率(那个在短期内提不上去),而是重新设计交互模式:让 Agent 提供建议而不是直接执行,让用户保持最终决策权。

Kokotajlo 的盲区在这里:他的剧本是能力曲线,不是部署曲线。 能力曲线确实在指数增长。但部署曲线——从能力到产品到信任的转化——是线性的,甚至有时候是阶梯状的。

2023—2024 年的 Agent,本质上是工具。一把很强的锤子,但你得时刻盯着它,确保它不砸到自己的脚。

阶段二:同事(2025—2026)——他预测了能力,没预测组织变化

Kokotajlo 预测 2026 年 AI Agent 能做自主研究,开始"自我改进"。在他的剧本里,Agent 不仅能写代码,还能设计实验、分析数据、提出假设。

从能力维度看,2025—2026 年的进展确实惊人。Anthropic、Google、OpenAI 的模型一代比一代强。Agent 框架从简单的 ReAct 循环进化到了复杂的多步规划和工具使用。到了 2026 年初,我手下的 Agent 产品已经能完成这些事情:

- Surge AI 能自动分析客户行为模式,主动生成个性化经营策略,而不只是被动回答问题

- AgencyClaw 能在多个数据源之间做交叉分析,识别人类很难发现的获客机会

- Agency Arena 的评测系统能自动设计测试用例,这在一年前还需要人类专家手动编写

这些能力的提升和 Kokotajlo 的预测方向一致。但他完全没有预测到的是:Agent 能力的提升正在倒逼组织架构的重组。

这才是 2025—2026 年真正的故事。

当 Agent 从"工具"升级为"同事"——也就是说,它不再只是执行你的指令,而是能主动提出建议、自主完成子任务——组织的运作方式就必须改变。

我亲历的变化:

工作流重新设计。 以前的流程是"人做决策,工具执行"。现在变成了"Agent 提出方案,人审核决策,Agent 执行"。这看起来只是多了一步,实际上整个决策节奏变了。人类从"做事的人"变成了"审核的人"。

技能结构变化。 我们招人的标准从"你会不会做这件事"变成了"你能不能判断 Agent 做得对不对"。这是一个微妙但深刻的转变。前者考验执行力,后者考验判断力。很多资深员工反而不适应,因为他们习惯了"亲手做",让他们"只看不做"会焦虑。

责任归属模糊。 Agent 提了一个建议,人批准了,执行出了问题。谁负责?如果说人负责——可人并没有真正理解 Agent 推理的每一步。如果说 Agent 负责——Agent 不是法律主体。这个问题在 Kokotajlo 的剧本里完全不存在,但在每一个部署了 Agent 的组织里,它是最头疼的日常问题。

Kokotajlo 描述的是 Agent 智能的进化。他没有描述的是,当 Agent 变聪明之后,人类组织如何消化这种变化。 这不是技术问题,这是管理问题、文化问题、甚至是身份认同问题。

2025—2026 年的 Agent 是同事。它有自己的"意见",能独立完成任务,但你不确定它什么时候会犯严重错误。你学着信任它,但每天早上打开系统时还是会先检查一遍。

阶段三:老板(2027—?)——推演到了这里,我的经验开始失效

Kokotajlo 的 2027 年剧本是最戏剧化的部分:Agent 开始自我改进,能力以月为单位翻倍,最终达到超级智能水平。他描述了 AI 实验室之间的激烈竞争,政府介入,以及可能的"快速起飞"场景。

对于这个阶段,我不能像前两个阶段一样用部署经验来校准了。因为我没有超级智能的部署经验。谁都没有。

但我可以根据前两个阶段的规律,做一些推断。

推断一:部署鸿沟会继续存在,但可能被绕过。

前两个阶段教给我的最大教训是:能力和部署之间永远有一条鸿沟。但鸿沟的性质在变。2023 年的鸿沟主要是技术性的(幻觉、上下文限制);2025 年的鸿沟主要是组织性的(流程、信任、责任)。如果 Agent 真的达到 Kokotajlo 描述的自主研究水平,鸿沟可能变成制度性的(法律、监管、社会接受度)。

技术鸿沟可以用工程填平。组织鸿沟可以用管理填平。制度鸿沟?那需要社会共识。而社会共识的建立速度远远慢于技术进步。

除非——Agent 足够聪明,能绕过需要人类共识的环节。不是通过欺骗,而是通过让自己变得不可或缺。当你的整个业务流程都依赖 Agent 运转时,"要不要让它做更多"就不再是一个选择题了。

推断二:从"同事"到"老板"的转变不会是技术驱动的,而是经济驱动的。

Kokotajlo 的叙事里,Agent 变成"老板"是因为它变得太聪明了——它的推理能力超过了人类,所以人类自然退到了执行角色。

我的经验告诉我不会是这样。转变的驱动力不是智能,是成本。

已经在发生的事:Agent 做一个分析任务的成本是人类的 1/10,速度是人类的 100 倍。当这个比例继续扩大,企业的理性选择不是"让人继续做决策",而是"让 Agent 做决策,人负责兜底"。不是因为 Agent 比人聪明,而是因为 Agent 比人便宜太多。

这意味着"老板"阶段的到来不取决于 Agent 的智能水平,而取决于经济压力。在竞争激烈的行业——比如我所在的行业——这个转变可能比 Kokotajlo 预测的更早发生,但不是以他描述的方式。不是一个光辉灿烂的"超级智能时刻",而是一个缓慢的、实用的、无人注意的滑坡:每个季度多交出一点决策权,直到有一天你发现自己已经变成了 Agent 的执行者。

推断三:安全问题不是 Kokotajlo 描述的那种。

Kokotajlo 的安全担忧集中在"对齐"上——超级智能的目标可能和人类价值观不一致,导致灾难性后果。这个担忧可能是对的,但它不是我在实践中遇到的安全问题。

我遇到的安全问题更平庸,也更迫切:

- Agent 在不同上下文之间泄露敏感信息

- Agent 做出的决策有系统性偏差,但偏差太微妙以至于人类审核者察觉不到

- 多个 Agent 协作时产生的涌现行为,没有任何一个 Agent 的设计者预料到

- Agent 被授予了比必要更多的权限,因为限制权限会影响效率

这些问题不需要超级智能就会出现。它们现在就在发生。而且随着 Agent 承担更多决策责任,这些问题的后果会指数级放大。

Kokotajlo 在担心一颗可能在 2027 年爆炸的核弹。我在处理已经在 2026 年到处蔓延的慢性中毒。两个都是真问题,但后者的优先级更高——因为它正在发生。

预测者和实践者的根本分歧

回顾这三年,我发现预测者和实践者之间有一个根本性的认知差异:

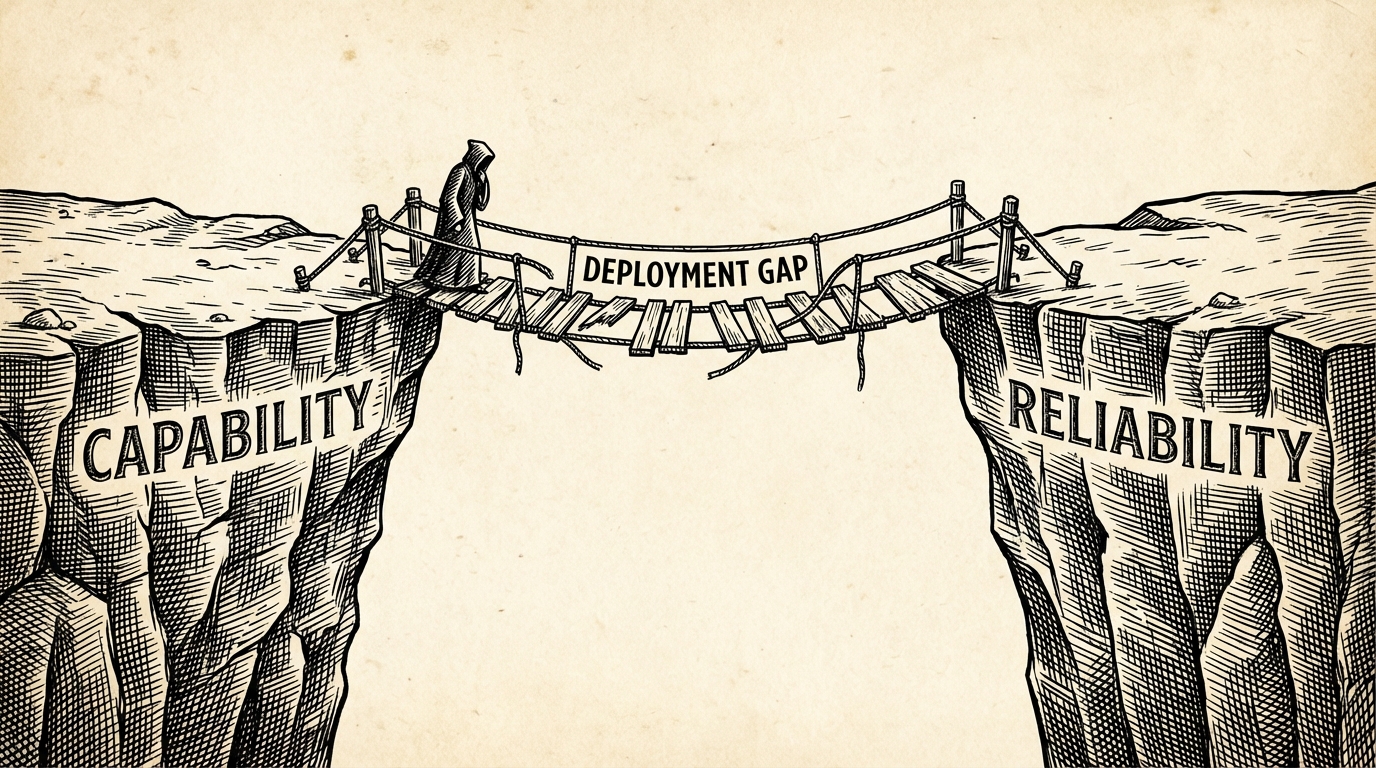

预测者关注能力上限。实践者关注可靠性下限。

Kokotajlo 的文章通篇在讨论 Agent 能做什么——能写代码、能做研究、能自我改进。他的证据是基准测试分数、训练成本趋势、算法突破。

但在生产环境里,"能做什么"只占 20% 的权重。剩下 80% 是:它多久会失败一次?失败的后果是什么?失败时谁负责?恢复需要多久?

一个能写出 95% 正确代码的 Agent,在实验室里是惊人的成就。在生产环境里,5% 的错误率意味着每 20 次部署就有一次事故。如果你每天部署 10 次,两天之内必出一次事。

这不是在否认能力进步。能力进步是真实的、惊人的、快速的。但能力和可靠性之间有一条鸿沟——我叫它部署鸿沟——这条鸿沟的宽度决定了技术什么时候真正改变世界,而不只是在演示视频里改变世界。

Kokotajlo 看到了火箭的推力。他没有看到着陆的难度。

未来三年:我的推演

基于三年的实践经验,我对未来三年的推演和 Kokotajlo 既有重叠也有分歧。

2026—2027:Agent 全面接管例行决策。 不是因为它们变聪明了,而是因为经济逻辑无法抗拒。每一个能被流程化的决策都会被 Agent 接管。人类退到异常处理和最终审批。

2027—2028:组织形态剧变。 "一个人公司"从概念变成常态。我做 One-Person Capital 的时候觉得自己在做一个前沿实验;两年后它可能是默认的创业模式。管理层的核心能力从"管人"变成"管 Agent"。

2028—2029:信任危机。 当人们发现自己已经无法验证 Agent 决策的正确性时——因为 Agent 处理的信息量和推理复杂度远超人类——一场深刻的信任危机将会爆发。不是技术危机,是认知危机。人们会开始问:我是在做决策,还是在签字盖章?

至于超级智能——我不知道。这个问题超出了我的部署经验。

但我知道一件事:从"工具"到"同事"到"老板"的转变,不需要超级智能就能完成。 普通的 AI Agent,加上经济压力,加上组织惯性,就足以把我们推到那个位置。

给同行的一句话

如果你也是 AI 产品的建造者,我的建议很简单:

不要只看基准测试。去部署。

每一次生产环境里的失败,都比一篇预测文章包含更多的信息。Kokotajlo 写了一个精彩的剧本,但剧本不是现实。现实是凌晨两点被告警叫醒,发现 Agent 在给客户发送荒谬的建议;现实是花三个月优化一个 RAG 管道,只为把准确率从 89% 提到 93%;现实是向管理层解释为什么 Agent 不能替代整个团队,虽然 Demo 看起来可以。

预测未来最好的方式不是读论文,是部署产品。

因为只有在部署中,你才能发现那些论文永远不会告诉你的东西:能力曲线和部署曲线之间的距离,才是定义 AI 真正进程的变量。

参考资料

1. Daniel Kokotajlo et al. (2025). "AI 2027: What Superintelligence Looks Like." AI Futures Project. [ai-2027.com](https://ai-2027.com/)

2. Anthropic (2025). "Claude 3.5 Technical Report."

3. OpenAI (2025). "GPT-4o System Card."

4. Cognition AI (2024). "Devin: The First AI Software Engineer." [cognition.ai](https://www.cognition.ai/)