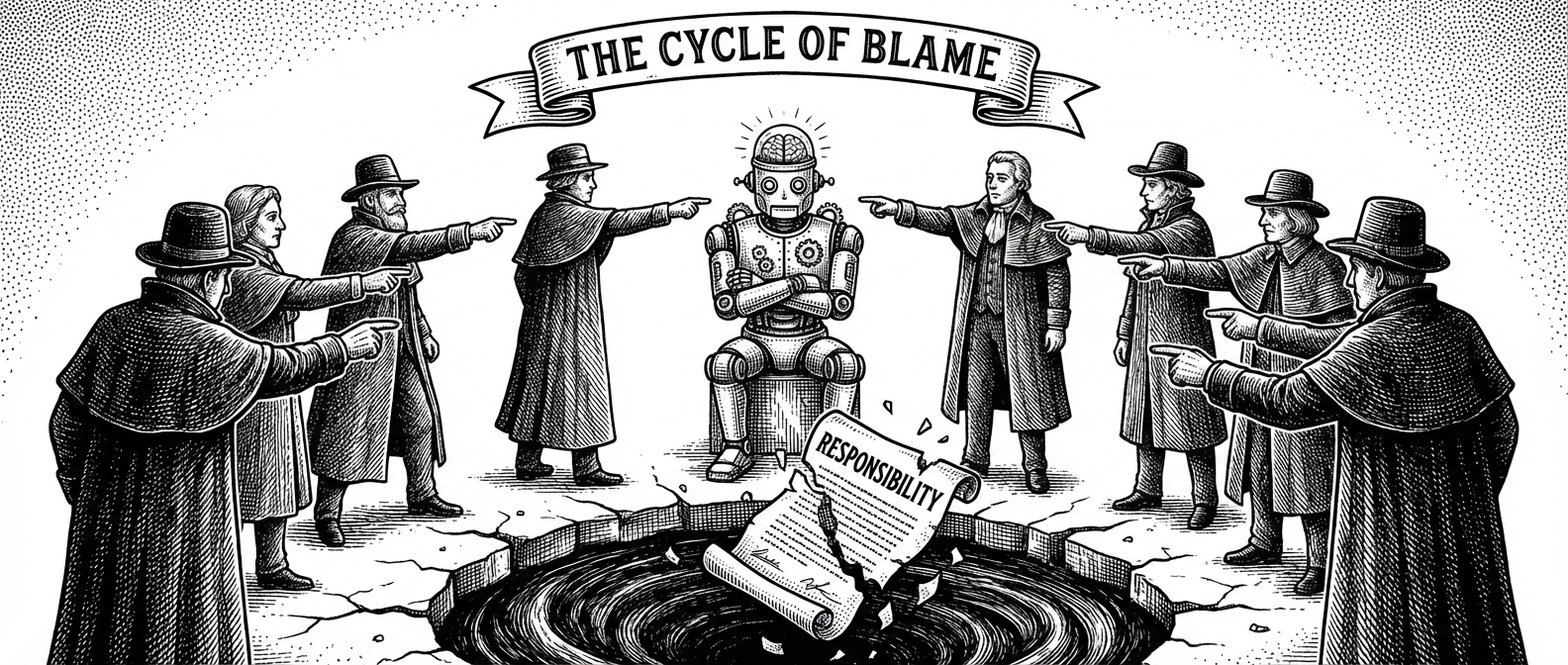

谁该为 AI 的决策负责?

当所有人都可以说"这不是我的决定,是 AI 的决定"时,问责就消失了。而问责消失的地方,灾难正在生长。

一次拒赔引发的问题

去年,我们的 AI 核保系统拒绝了一份重疾险申请。

申请人是一个 35 岁的男性,体检数据完全正常,但 AI 综合了他的职业风险评分、居住区域健康数据和一些行为特征后,给出了"高风险"的判定,自动触发了拒保流程。

客户投诉了。他问了一个简单的问题:"谁做的这个决定?"

我们的客服说:"系统自动判定的。"客户问:"那谁对这个系统负责?"客服沉默了。

是写代码的工程师负责吗?他只是按照需求文档实现了算法。是定义需求的产品经理负责吗?她只是把业务规则翻译成了产品逻辑。是审批上线的管理层负责吗?他们看的是整体通过率和赔付率,不会审核每一个个案。是 AI 模型本身负责吗?它没有法律人格,无法被追责。

这个问题在组织里转了一圈,没有落到任何一个人身上。

Martin Sustrik 在他 2025 年的文章里给这种现象起了个名字:问责黑洞(accountability sink)。

什么是问责黑洞

Sustrik 的定义很精确:问责黑洞是一种组织结构,在这个结构中,被追责的人对结果没有实际控制权,而真正有控制权的人被结构性地隔离在问责之外。

这不是推诿。推诿是"我不想负责"。问责黑洞是"组织的设计方式让没有人能负责"。

他举了一个经典例子:酒店的取消政策。你打电话给前台要求延迟退房,前台说"对不起,这是系统规定"。前台是被追责的人——他承受了你的愤怒——但他对这个政策没有任何决定权。而制定政策的管理层,你永远见不到,永远追不到。

前台成了问责黑洞。他吸收了所有的问责压力,但对结果无能为力。

Sustrik 指出,问责黑洞可以是破坏性的——让坏决策的始作俑者逃脱追责;也可以是建设性的——保护创新者不受短期压力的干扰。一个研发实验室的负责人用"这是董事会的决定"来挡住来自销售团队的压力,好让团队专心做长期研究——这就是建设性的问责黑洞。

但 AI 创造了第三种问责黑洞:既不是破坏性的,也不是建设性的,而是纯粹的缺失。没有人有意地设计了它,没有人有意地利用它,它只是随着 AI 决策的渗透而自然生长出来。

这才是最危险的。

我在保险行业看到的问责真空

保险是一个对问责有法律刚性要求的行业。每一份保单的承保和拒保,都需要有可追溯的决策路径。监管要求你能解释为什么接受或拒绝一个客户。

然后 AI 来了。

我过去三年做了七个以上的 AI Agent 产品。在保险核保、客户经营、理赔预审等场景里,AI 的决策每天影响着成千上万的客户。我亲眼看到问责链条是如何被一步步侵蚀的。

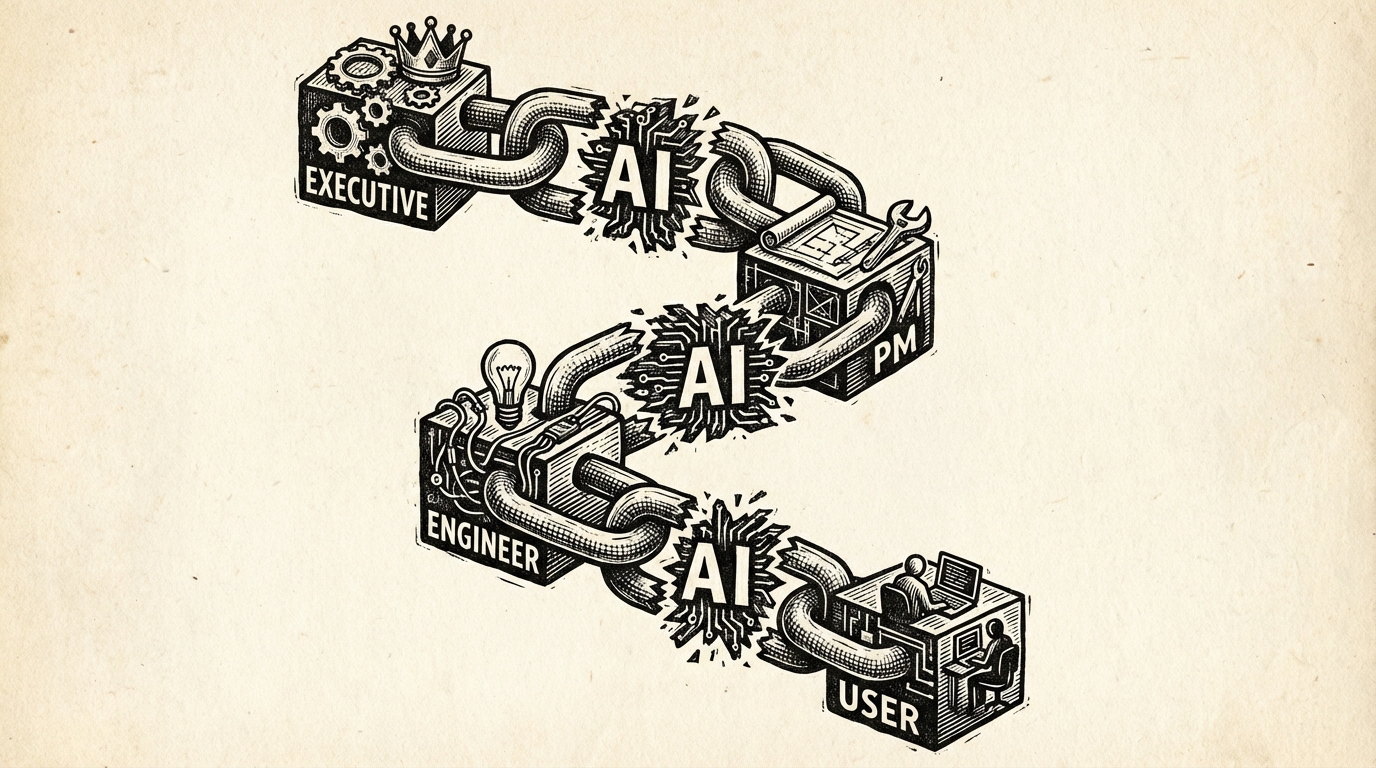

第一步:AI 从"辅助"变成"主导"。 最初,AI 只是给人类核保师提供参考意见,最终决策权在人。但效率压力是真实的——当 AI 能在 3 秒内完成人类需要 3 天的工作时,谁会真的花 3 天去复核?核保师开始无条件接受 AI 的建议。名义上人在决策,实际上人只是在盖章。

第二步:盖章的人消失了。 效率进一步优化后,连盖章的人都被精简了。AI 直接做决策,人只处理异常。但"异常"的定义权也在 AI 手上——它决定什么是异常,什么不是。

第三步:出了问题找谁? 当一个客户被错误拒保时,问责链条断裂了。工程师说:"模型是按照训练数据和业务规则运行的。"产品经理说:"我定义的是大方向,不是每个个案的判断。"管理层说:"我批准的是整体方案,不是具体的算法参数。"

问责沿着组织架构向上传递,到每一层都被稀释一点,最后彻底蒸发。

这不是 Sustrik 描述的那种有人刻意设计的问责黑洞。没有人故意把责任推给 AI。而是 AI 决策的技术特性——黑箱性、概率性、规模化——让传统的问责结构自动失效了。

问责链断裂的四个机制

在过去几年的实践中,我总结出 AI 瓦解问责的四个具体机制:

机制一:决策的不可解释性。 传统的核保拒绝有明确的理由——"您的 BMI 超标"、"您有家族病史"。AI 的决策是多维特征的加权结果,往往连构建它的工程师都无法精确解释为什么某个申请被拒。当决策无法被解释时,问责就失去了锚点。你怎么追究一个你无法理解的决定?

机制二:责任的无限分割。 一个 AI 决策涉及的人包括:收集训练数据的人、清洗数据的人、设计模型架构的人、调参的人、定义业务规则的人、审批上线的人、监控运行的人。每个人都只负责链条上的一小段。当出了问题时,每个人的贡献都"不足以构成责任"。

机制三:决策的规模化稀释。 一个人类核保师一天处理 50 份申请,每一份都是有意识的决策行为。一个 AI 系统一天处理 50000 份。当决策的密度达到这个量级,"为每个决策负责"在物理上就不可能了。问责被规模稀释成了统计指标——"整体准确率 98%"。那 2% 里的每个真实的人,掉进了统计的缝隙。

机制四:时间的断裂。 AI 模型的训练和部署之间可能隔着几个月。做出决策时的模型参数,可能是半年前基于当时的数据训练出来的。当半年后一个决策出了问题,当时的上下文已经不存在了。训练数据可能已经更新,团队成员可能已经离职。问责找不到时间上的锚点。

监管在追赶,但追不上

保险和银行业的监管者已经注意到了这个问题。

欧盟的 AI Act 要求高风险 AI 系统具备可解释性和人类监督。中国的《生成式人工智能服务管理暂行办法》要求提供者对 AI 生成内容负责。新加坡的 MAS 对金融机构使用 AI 有专门的治理指引。

但监管面临一个根本困境:它试图用传统的"谁做了决定谁负责"的框架来规范一个"没有人做决定"的系统。

传统监管假设决策链是线性的:有人提案,有人审批,有人执行。每一步都有明确的责任人。但 AI 的决策链不是线性的,而是网状的——数据、算法、规则、参数、环境变量交织在一起,形成了一个没有起点也没有终点的决策网络。

你可以要求"人类在回路中"(human in the loop),但如果人类只是在盖章,这个要求就是形式主义。你可以要求可解释性,但如果解释是事后用另一个模型拟合出来的"近似解释",这个透明性就是虚假的。

监管在追赶 AI 创造的问责真空,但 AI 跑得更快。

不是破坏,不是建设,是缺失

回到 Sustrik 的框架。他区分了破坏性问责黑洞(保护坏决策)和建设性问责黑洞(保护创新)。

AI 创造的问责黑洞不属于任何一类。

破坏性问责黑洞有一个受益者——某个人或某个群体在利用这个结构逃避责任。但 AI 的问责真空里没有受益者。没有人策划了它,没有人因此获益。

建设性问责黑洞有一个目的——保护某种有价值的活动免受短期压力。但 AI 的问责真空没有目的。它不是在保护任何东西,它只是一个空洞。

AI 创造的是一种新型的问责黑洞:无主的、无目的的、自我生长的。 它随着 AI 渗透率的提升而自动扩大,不需要任何人的推动。

这是比"谁负责"更深层的问题。在传统的问责黑洞里,至少有一个可以被修复的结构。你可以改变酒店的政策,让前台有权延迟退房。你可以改变组织架构,让决策者直接面对客户。但 AI 的问责真空不是一个可以被修复的结构性缺陷——它是 AI 决策本身的内在属性。

只要决策是由算法做出的、规模是人类无法逐一审视的、逻辑是统计性而非因果性的,问责真空就必然存在。

一个实践者的三个原则

我没有解决方案。如果有人告诉你他有,那他要么在卖你东西,要么没真正做过这个事。

但我有三个在实践中形成的原则:

原则一:保留可问责的决策节点。 在我们的系统里,我坚持在关键决策点保留人类审核。不是所有决策——那会让系统退化回人工时代——而是那些后果严重且不可逆的决策。拒保、大额理赔、客户黑名单。这些决策必须有一个具体的人签字,并且这个人必须有权推翻 AI 的建议。不是走形式的盖章,而是真正的审核权。

原则二:构建问责的"考古记录"。 每一个 AI 决策都必须留下完整的上下文快照:当时的模型版本、输入特征、决策路径、置信度。不是为了让人看——50000 条记录没人看得过来——而是为了当出了问题时,有一条可以追溯的线索。这不是事后解释,这是事前的问责基础设施。

原则三:把"谁负责"写进系统设计里,而不是事后追加。 在每个 AI 产品的设计阶段,我要求团队回答一个问题:"当这个 AI 做出错误决策时,谁是第一个被叫到会议室的人?"如果答不出来,这个产品的问责设计就是有缺陷的,不能上线。

这三个原则不能解决问责真空。它们只能减缓真空的扩大速度。

最后的问题

Sustrik 的文章让我意识到,问责黑洞不是 bug,而是组织复杂性的必然产物。AI 只是把这个必然性推到了一个新的极端。

但我想在他的框架上加一句:

当问责黑洞是人造的,至少我们知道它在哪里。当问责黑洞是 AI 生长出来的,我们甚至不知道它在哪里——直到有人掉进去。

作为一个在受监管行业部署 AI 的实践者,我每天都在跟这个问题博弈。我不敢说我做得好。我只能说,我在每一个设计决策里,都会问自己这个问题:

"如果这个 AI 今天做了一个错误的决定,明天能不能找到一个真实的人来承担责任?"

如果答案是不能,那这个系统就不应该上线。不管它的效率有多高。

因为效率可以重建,但问责一旦消失,就很难再找回来。

参考资料

1. Martin Sustrik (2025). "Accountability Sinks." 452 karma.

2. 中华人民共和国国家互联网信息办公室 (2023). 《生成式人工智能服务管理暂行办法》.

3. European Commission (2024). Regulation (EU) 2024/1689 — Artificial Intelligence Act.

4. Monetary Authority of Singapore (2025). Guidelines on Use of AI in Financial Institutions.