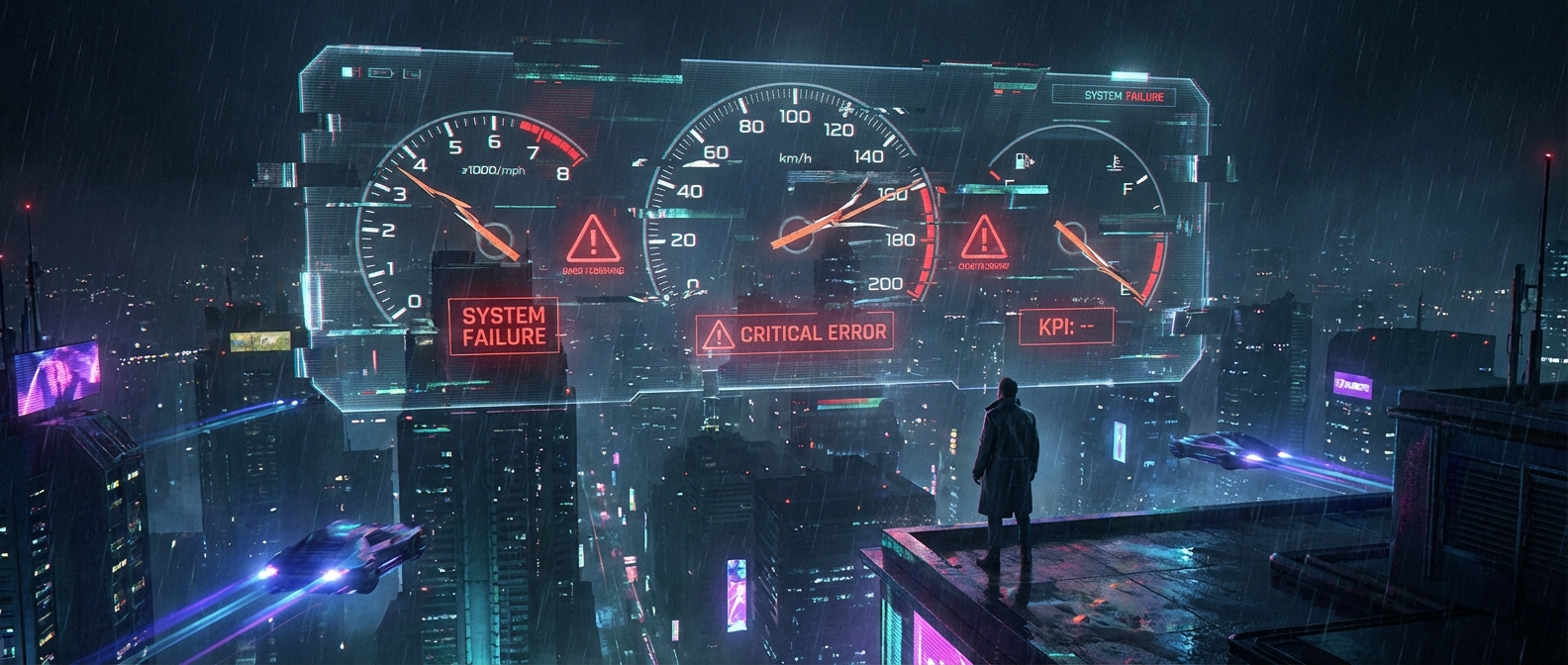

你的 KPI 在骗你

实验设计第一定律:你测的不是你以为在测的东西。——johnswentworth

"数据驱动"的前提是假的

每家科技公司都说自己是"数据驱动"的。

产品经理盯着 DAU 做决策。增长团队拿 conversion rate 汇报。工程团队用代码覆盖率衡量质量。管理层看 ARR 判断公司健康度。整个组织像一台精密仪表盘,每个人都在看自己的仪表。

但有一个问题几乎没人问:你的仪表测的真的是你以为在测的东西吗?

LessWrong 上有一个叫 johnswentworth 的人,他曾在一家创业公司做数据科学家。他写了一篇高赞文章,提出了两条"实验设计定律"。第一条简单到令人不安:

你测的不是你以为在测的东西。

不是偶尔不是。是几乎总是不是。

一个让我后背发凉的故事

johnswentworth 讲了他在创业公司的亲身经历。

他们在做网站注册流程的 A/B 测试。改按钮颜色、调整页面顺序、优化文案——标准的增长黑客套路。有些实验"成功"了,数据显示转化率提升。团队庆祝,汇报给投资人。

后来他深入调查,发现了一个令人震惊的事实:真正影响转化率的不是按钮颜色,是服务器延迟。

300 毫秒的延迟就能让点击率下降 30%。几秒的延迟直接砍掉 80% 以上。而那些"成功"的 A/B 测试,恰好是在服务器性能波动较低的时段跑的。

他们以为在测用户偏好,实际在测服务器性能。

所有的"数据驱动决策",建立在一个根本性的错误之上。

这个故事让我后背发凉,因为我知道——我做的事情也有同样的问题。

我做评测平台,我比谁都清楚度量有多脆弱

我现在在做的一个项目叫 Agency Arena,是一个 AI Agent 评测与竞技平台。它的存在意义就是回答一个问题:哪个 Agent 更好?

听起来很直接。但当你真正深入评测设计时,你会发现"更好"这两个字是一个无底洞。

更快就是更好吗?一个 Agent 用 3 秒完成任务,另一个用 30 秒——但 3 秒那个跳过了关键验证步骤,30 秒那个做了完整的错误处理。谁更好?

完成率更高就是更好吗?一个 Agent 声称完成了 95% 的任务,但其中 20% 是"伪完成"——表面上给出了答案,实际上答案是错的或者不完整的。另一个 Agent 完成率只有 70%,但完成的每一个都是高质量的。谁更好?

你以为在测"能力",实际在测什么?

2025 年,AI 评测行业爆发了一场丑闻。LMArena(前身 LMSYS Chatbot Arena),一度是业界公认最权威的大模型排行榜,被一篇来自 Cohere、Stanford、MIT 研究者的论文揭穿了系统性问题。

论文发现:Meta 在 Llama-4 发布前私下测试了 27 个模型变体,只公布表现最好的结果。OpenAI、Google、Amazon 都在做类似的事情。研究者估算,仅仅是增加对 Arena 数据的访问权限,就能将模型的 Arena 评分提升高达 112%。

排行榜以为在测模型能力,实际在测谁更会刷分。

这不是个别现象。这是度量系统在优化压力下的必然结果。经济学家早就给这个现象起了名字:Goodhart 定律——当一个度量变成目标,它就不再是好的度量。

你公司里的度量也在骗你

你可能觉得这是 AI 行业特有的问题。不是。Goodhart 定律无处不在,尤其在你每天看的那些 KPI 里。

DAU(日活跃用户)

你以为在测产品受欢迎程度,实际在测什么?

可能在测推送通知的骚扰强度。用户被推送拉回来,打开 APP 0.3 秒后关掉——算一个日活。DAU 涨了,但用户对产品的真实态度可能在恶化。

NPS(净推荐值)

你以为在测客户满意度,实际在测什么?

可能在测问卷投放时机。在用户刚完成一次成功操作后弹出 NPS 问卷,分数自然高。在用户遇到问题时弹出,分数自然低。NPS 可能更多地反映了你选择在什么时候问这个问题。

代码覆盖率

你以为在测代码质量,实际在测什么?

可能在测团队写无意义测试的勤奋程度。我管过百人技术团队,我见过工程师为了把覆盖率从 78% 刷到 80% 而写大量断言空值的测试。覆盖率达标了,但代码质量没有任何提升。

AI Agent 任务完成率

你以为在测 Agent 能力,实际在测什么?

可能在测任务描述的模糊程度。任务描述越模糊,"完成"的标准越宽松,完成率越高。一个 Agent 在宽松标准下 95% 完成率和另一个在严格标准下 70% 完成率,谁更强?没人知道,因为你连自己在测什么都没搞清楚。

每一个你以为在测 X 的指标,实际上都在测 X + 一堆你看不见的混杂变量。而混杂变量往往比 X 本身的影响更大。

为什么度量失败几乎不可避免

度量失败不是因为你不够聪明。它几乎是一个结构性的必然。

第一,混杂变量永远存在。

johnswentworth 引用了一个经典的"费曼的老鼠"故事。一个研究者训练老鼠走进特定的门,实验反复失败。他系统地控制了油漆气味、灯光、走廊材质——都没用。最后发现,老鼠是通过地板振动来导航的。只有铺沙子才消除了这个混杂变量。

你控制不了你看不见的东西。而你看不见的东西,往往才是真正在起作用的。

第二,优化压力会找到度量系统中的每一个漏洞。

这是 Goodhart 定律的深层机制。一旦一个度量变成目标,整个系统的优化压力就会集中在这个度量上——不是集中在度量背后那个你真正关心的东西上,而是集中在度量本身上。

公司把 DAU 定为 KPI → 产品团队优化推送频率 → DAU 上升 → 用户真实使用深度下降 → 但没人关心,因为 KPI 达标了。

AI 公司把排行榜排名定为目标 → 工程团队优化 benchmark 表现 → 排名上升 → 真实任务表现不变 → 但没人关心,因为排行榜好看了。

度量系统就像一道堤坝。水(优化压力)永远会找到最薄弱的地方漫过去。

第三,单一指标就像只用一个传感器开飞机。

飞机不会只装一个高度计就上天。它有高度计、空速表、姿态仪、GPS、无线电高度表——数十个传感器交叉验证,才能确保你真正知道自己在哪里。

但我们公司的决策系统呢?一个 DAU,一个 ARR,一个 NPS——三个数字就敢拍板百万级的产品决策。这不是数据驱动,这是盲人摸象。

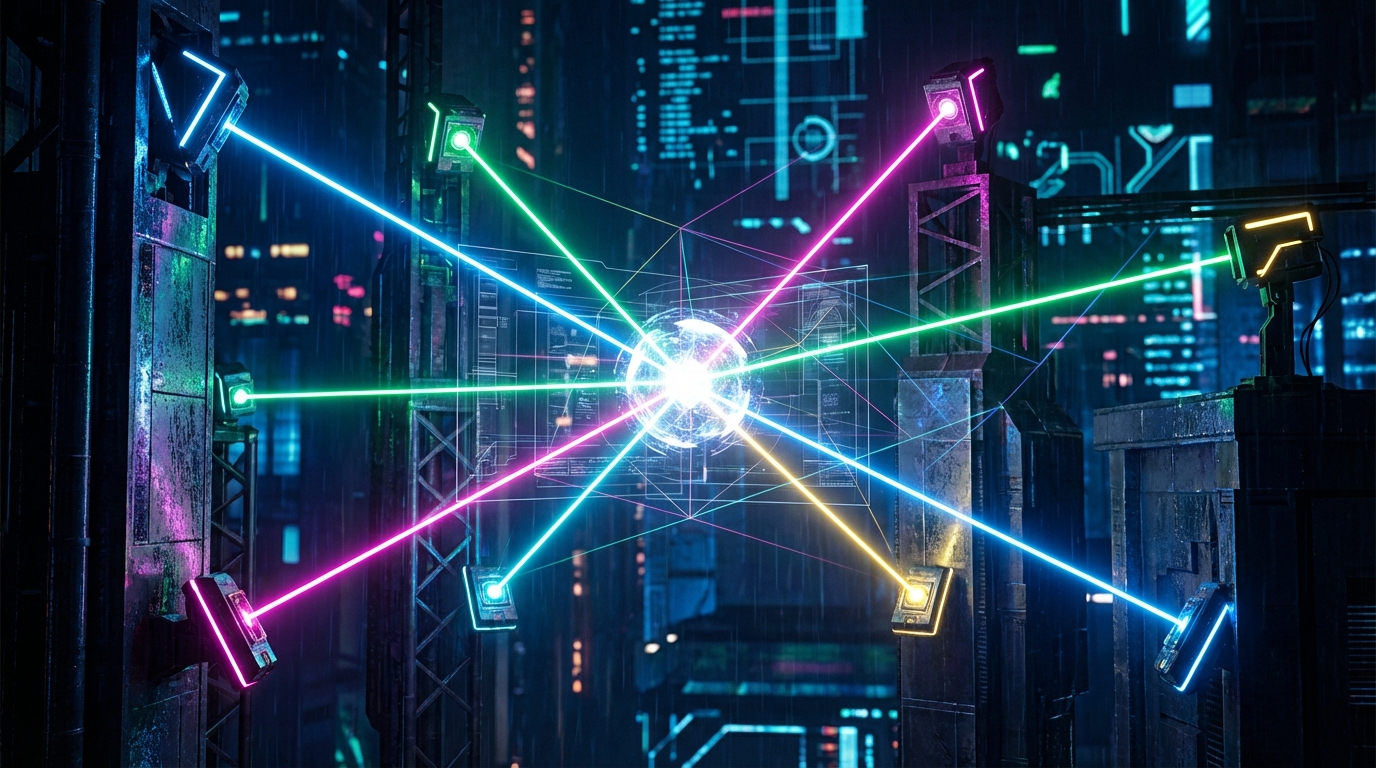

第二定律:解药在"测更多"

johnswentworth 的第二条定律给了出路:

"如果你测足够多不同的东西,你也许能搞清楚自己到底在测什么。"

这不是说收集更多数据。是说从多个独立维度去观测同一个现象,通过交叉验证来逼近真相。

这个思路深刻影响了我做 Agency Arena 的方式。

我们不做单一排行榜。 一个总分排名是 Goodhart 的完美靶子。我们做多维度评测——任务完成质量、推理过程合理性、错误恢复能力、资源效率、边缘情况处理——每个维度独立评分,不合成总分。

我们公开评测方法。 不透明的评测就像不公开代码的安全系统——它的安全性建立在无知之上,而不是建立在正确性之上。公开方法意味着所有人都能审视度量的合理性,发现盲点。

我们关注评测失败的案例。 一个评测体系最有信息量的不是它答对了什么,而是它答错了什么。当评测结果和人类专家判断出现分歧时,那个分歧点就是混杂变量的藏身之处。

这些做法不能完全消除度量幻觉。但它们把"一个传感器开飞机"升级成了"多传感器交叉验证"——至少,你能更快地发现自己在骗自己。

给每个看数字的人的三个问题

如果你是产品经理、技术管理者、或者任何需要"用数据做决策"的人,我建议你在看到任何一个指标时,先问三个问题:

第一:这个指标的混杂变量可能是什么?

DAU 的混杂变量可能是推送策略。转化率的混杂变量可能是服务器性能。Agent 完成率的混杂变量可能是任务难度分布。在你分析数字之前,先列出至少三个可能的混杂变量。

第二:如果有人想刷这个指标,最简单的方法是什么?

这个思想实验能帮你快速发现度量系统的漏洞。如果刷的成本很低,那这个指标的可信度就很低。一个好的度量应该很难被 gaming——刷它的唯一方法就是真正做好你想衡量的那件事。

第三:还有哪些独立的信号可以交叉验证?

DAU 要配合使用时长、核心功能使用频率、留存曲线。Agent 完成率要配合人类专家抽检、错误率、用户反馈。单一数字永远不够。至少需要三个独立维度。

最后的坦白

写这篇文章的时候,我反复想到一件事:我自己就是度量系统的建设者。

我做的 Agency Arena,本质上就是一个"用数字评判 Agent 好坏"的平台。我比任何人都清楚,任何度量系统都有盲区,任何排行榜都会被 gaming,任何 KPI 都会在优化压力下变形。

但我还是在做。

因为替代方案更糟。没有度量的世界不是更诚实的世界——而是纯粹靠故事、靠营销、靠声量来做判断的世界。那个世界的失真比 Goodhart 定律严重一百倍。

度量的价值不在于它是完美的。度量的价值在于它是可以被质疑、被审视、被改进的。

故事不行。直觉不行。只有度量,才能被证伪。

所以,下次你看到一个让你兴奋的数字时,先停一秒,问自己:

"我真的知道这个数字在测什么吗?"

如果答案是"当然知道"——那你大概率是错的。

参考资料

1. johnswentworth (2022). "You Are Not Measuring What You Think You Are Measuring." LessWrong. [lesswrong.com](https://www.lesswrong.com/posts/9kNxhKWvixtKW5anS/you-are-not-measuring-what-you-think-you-are-measuring)

2. Collinear AI (2025). "Gaming the System: Goodhart's Law Exemplified in AI Leaderboard Controversy." [blog.collinear.ai](https://blog.collinear.ai/p/gaming-the-system-goodharts-law-exemplified-in-ai-leaderboard-controversy)

3. Luo et al. (2025). "Can We Trust AI Benchmarks? An Interdisciplinary Review of Current Issues in AI Evaluation." arXiv. [arxiv.org](https://arxiv.org/html/2502.06559v1)

4. "The Measurement Imbalance in Agentic AI Evaluation Undermines Industry Productivity Claims." arXiv, 2025. [arxiv.org](https://arxiv.org/html/2506.02064v2)